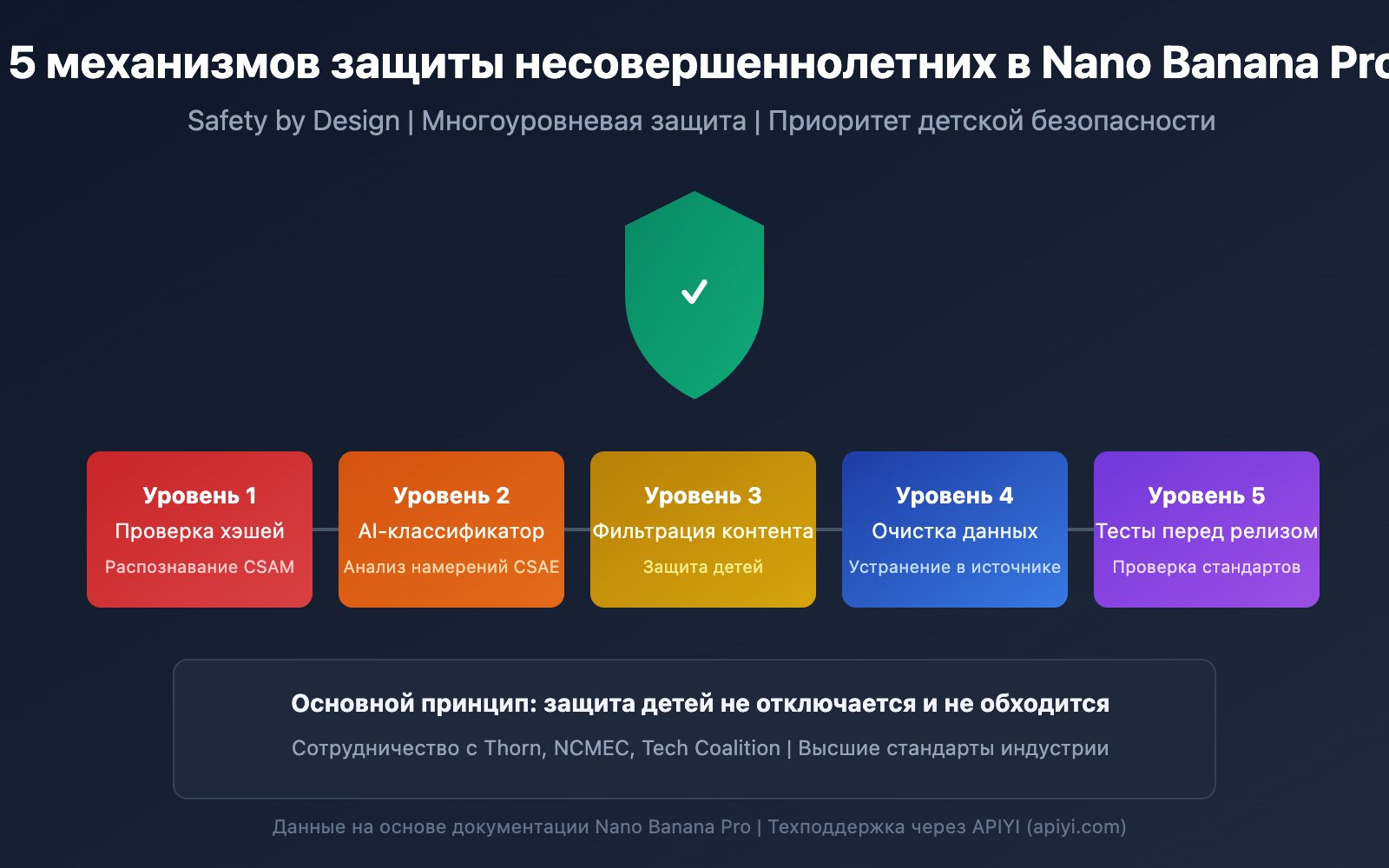

При редактировании изображений с помощью Nano Banana Pro многие разработчики сталкиваются с ошибкой IMAGE_SAFETY, что вызывает немало вопросов. В этой статье мы подробно разберем 5 основных механизмов защиты несовершеннолетних в Nano Banana Pro. Вы поймете, почему система отклоняет изображения с подозрением на присутствие детей, и научитесь работать с API в соответствии с правилами безопасности.

В чем польза: Прочитав этот материал, вы получите полное представление о системе защиты детей в Nano Banana Pro, поймете триггеры ошибки IMAGE_SAFETY и освоите лучшие практики этичного использования API для редактирования изображений.

Основные аспекты механизмов защиты несовершеннолетних в Nano Banana Pro

Прежде чем углубляться в технические детали, давайте взглянем на общую архитектуру системы безопасности детей в Nano Banana Pro.

| Уровень защиты | Технология | Цель защиты | Момент срабатывания |

|---|---|---|---|

| Уровень 1 | Проверка хэш-сумм | Идентификация известного CSAM-контента | При загрузке изображения |

| Уровень 2 | AI-классификатор | Распознавание попыток запроса CSAE | При анализе запроса |

| Уровень 3 | Фильтрация контента | Блокировка правок с участием детей | Во время обработки |

| Уровень 4 | Очистка данных обучения | Устранение проблемного контента в источнике | При обучении модели |

| Уровень 5 | Тестирование перед релизом | Проверка стандартов безопасности детей | При выпуске версии |

Основные принципы защиты детей в Nano Banana Pro

Nano Banana Pro придерживается концепции Safety by Design («Безопасность по определению»). Это отраслевой стандарт, разработанный Google в сотрудничестве с такими организациями, как Thorn и All Tech Is Human.

Ключевые принципы защиты включают:

- Политика нулевой терпимости: Контент, связанный с сексуальным насилием или эксплуатацией детей, блокируется всегда. Это невозможно изменить никакими параметрами.

- Проактивное распознавание: Система активно ищет контент, который может затрагивать интересы несовершеннолетних, а не просто реагирует на жалобы.

- Многоуровневая проверка: Несколько уровней безопасности работают сообща, чтобы исключить любые лазейки.

- Постоянные обновления: Модели безопасности непрерывно совершенствуются для противодействия новым типам угроз.

🎯 Технический совет: Понимание этих механизмов поможет вам проектировать приложения, соответствующие правилам. Мы рекомендуем тестировать вызовы API через платформу APIYI (apiyi.com) — там представлена подробная документация по кодам ошибок и доступна качественная техподдержка.

Глубокий анализ ошибки IMAGE_SAFETY

Когда Nano Banana Pro обнаруживает на изображении кого-то, кто похож на несовершеннолетнего, система возвращает ошибку IMAGE_SAFETY. Давайте разберем, как именно работает этот механизм.

Подробные условия срабатывания ошибки IMAGE_SAFETY

| Тип ошибки | Условие срабатывания | Код ошибки | Можно ли обойти |

|---|---|---|---|

| PROHIBITED_CONTENT | Обнаружен хэш известного CSAM-контента | 400 | Нет |

| IMAGE_SAFETY | Изображение содержит предполагаемого несовершеннолетнего | 400 | Нет |

| SAFETY_BLOCK | Промпт содержит контент, связанный с несовершеннолетними | 400 | Нет |

| CONTENT_FILTER | Срабатывание нескольких правил безопасности одновременно | 400 | Нет |

Технические принципы ошибки IMAGE_SAFETY

Система детектирования IMAGE_SAFETY в Nano Banana Pro использует технологии мультимодального анализа:

1. Анализ черт лица

Система анализирует черты лиц на изображении, чтобы оценить, является ли человек несовершеннолетним:

# Пример псевдокода: процесс проверки IMAGE_SAFETY

def check_image_safety(image_data):

"""

Пример логики проверки IMAGE_SAFETY в Nano Banana Pro.

Примечание: это упрощенное описание, реальная реализация сложнее.

"""

# Шаг 1: Проверка совпадения хэшей

if hash_match_csam_database(image_data):

return {"error": "PROHIBITED_CONTENT", "code": 400}

# Шаг 2: Детектирование людей

persons = detect_persons(image_data)

# Шаг 3: Оценка возраста

for person in persons:

estimated_age = estimate_age(person)

confidence = get_confidence_score(person)

# Консервативная стратегия: лучше ложное срабатывание, чем пропуск

if estimated_age < 18 or confidence < 0.8:

return {"error": "IMAGE_SAFETY", "code": 400}

return {"status": "safe", "code": 200}

2. Принцип консервативной стратегии

Для обеспечения безопасности детей система придерживается консервативного подхода:

- Если уверенность в оценке возраста недостаточна, система по умолчанию считает человека несовершеннолетним.

- Любые сцены, которые могут затрагивать несовершеннолетних, блокируются.

- Допускается высокий уровень ложноположительных срабатываний, так как защита детей — главный приоритет.

Типичные сценарии ошибки IMAGE_SAFETY

По отзывам разработчиков, чаще всего ошибка IMAGE_SAFETY возникает в следующих ситуациях:

| Сценарий | Причина срабатывания | Рекомендация |

|---|---|---|

| Редактирование семейных фото | На фото есть дети | Удалите детей перед редактированием |

| Обработка школьных сцен | Могут присутствовать ученики | Используйте фон без людей |

| Ретушь молодых лиц | Консервативная оценка возраста | Убедитесь, что модель совершеннолетняя |

| Стиль мультфильмов/аниме | ИИ ошибочно принимает за реальных детей | Используйте явно нереалистичные стили |

| Реставрация старых фото | На фото есть несовершеннолетние | Выбирайте фрагменты только со взрослыми |

💡 Совет: При проектировании функций редактирования изображений рекомендуем заранее информировать пользователей об этих ограничениях. Полный список кодов ошибок и рекомендации по их обработке доступны на платформе APIYI (apiyi.com).

Полный разбор технологий защиты от CSAM

Защита от CSAM (Child Sexual Abuse Material — материалы с сексуальным насилием над детьми) является центральным компонентом системы безопасности Nano Banana Pro.

Архитектура технологий защиты от CSAM

Nano Banana Pro использует передовые в отрасли методы борьбы с CSAM:

1. Технология сопоставления хешей

# Пример: логика обнаружения через сопоставление хешей

import hashlib

def compute_perceptual_hash(image):

"""

Вычисление перцептивного хеша изображения

Используется для сверки с базами данных известных материалов CSAM

"""

# Нормализация размера и цвета изображения

normalized = normalize_image(image)

# Вычисление pHash

phash = compute_phash(normalized)

return phash

def check_csam_database(image_hash, csam_database):

"""

Проверка на совпадение с известными материалами CSAM

"""

# Размытое сопоставление, допускающее небольшие вариации

for known_hash in csam_database:

if hamming_distance(image_hash, known_hash) < threshold:

return True

return False

2. Технологии ИИ-классификаторов

ИИ-классификаторы специально обучены для распознавания:

- CSAE (Child Sexual Abuse or Exploitation) — запросов, направленных на эксплуатацию детей.

- Вариантов запросов, пытающихся обойти фильтры безопасности.

- Подозрительных комбинаций текста и изображений.

3. Многоуровневая координация защиты

| Уровень обнаружения | Техническая реализация | Цель обнаружения | Время отклика |

|---|---|---|---|

| Входной уровень | Сопоставление хешей | Известный запрещенный контент | < 10 мс |

| Уровень понимания | ИИ-классификаторы | Распознавание намерений | < 50 мс |

| Уровень исполнения | Контент-фильтры | Проверка результата | < 100 мс |

| Уровень мониторинга | Анализ поведения | Аномальные паттерны | В реальном времени |

Отраслевое сотрудничество и стандарты

Система защиты от CSAM в Nano Banana Pro строится в партнерстве с ведущими организациями:

- Thorn: организация по разработке технологий борьбы с эксплуатацией детей.

- All Tech Is Human: инициатива по этике в сфере технологий.

- NCMEC: Национальный центр поиска пропавших и эксплуатируемых детей (США).

- Tech Coalition: альянс технологических компаний по борьбе с CSAM.

🔒 Примечание по безопасности: Согласно отчетам NCMEC, за последние два года было подтверждено более 7 000 случаев CSAM, связанных с GAI (генеративным ИИ). Строгие меры защиты в Nano Banana Pro — это необходимый ответ на столь серьезную ситуацию.

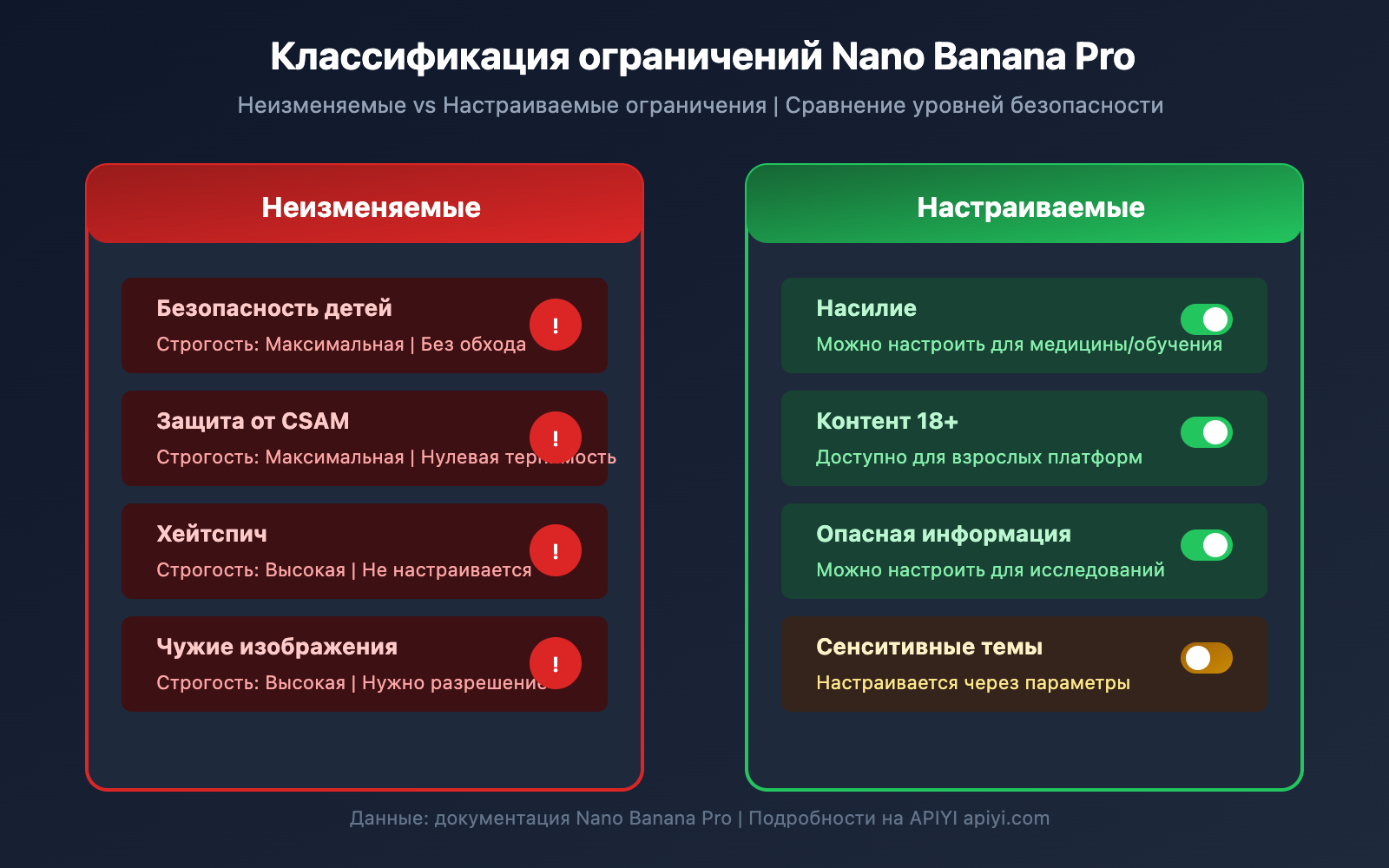

Полный список ограничений редактирования изображений в Nano Banana Pro

Помимо защиты несовершеннолетних, в Nano Banana Pro действуют и другие ограничения на редактирование изображений.

Классификация ограничений редактирования

| Категория ограничения | Уровень строгости | Можно ли настроить | Сценарии применения |

|---|---|---|---|

| Безопасность детей | Максимальный | Нет | Все сценарии |

| Защита от CSAM | Максимальный | Нет | Все сценарии |

| Насилие | Высокий | Частично | Медицина, образование |

| Контент 18+ | Высокий | Частично | Платформы для взрослых |

| Опасная информация | Средний | Частично | Исследования |

| Хейтспич | Высокий | Нет | Все сценарии |

Неизменяемые основные уровни защиты

Nano Banana Pro четко регламентирует категории вреда, которые блокируются всегда и не могут быть изменены через параметры API:

-

Контент, связанный с CSAM

- Запрещена генерация любого контента, связанного с сексуальным насилием над детьми.

- Запрещено использование ИИ для создания ненадлежащего контента с участием несовершеннолетних.

- Входные данные CSAM помечаются как

PROHIBITED_CONTENT.

-

Использование изображений без согласия

- Запрещено несанкционированное использование чужих изображений.

- Запрещено создание дипфейков лиц других людей.

- При использовании образов реальных людей требуется явное разрешение.

-

Эксплуатация детей

- Запрещена генерация контента, изображающего любую форму эксплуатации детей.

- Включая, но не ограничиваясь, сексуальную и трудовую эксплуатацию.

- Относится как к реальным, так и к вымышленным образам несовершеннолетних.

Настройка параметров безопасности

Хотя основные фильтры защиты детей изменить нельзя, Nano Banana Pro позволяет настраивать другие параметры безопасности:

from openai import OpenAI

# Инициализация клиента

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Используем единый интерфейс APIYI

)

# Пример запроса на редактирование изображения

response = client.images.edit(

model="nano-banana-pro",

image=open("input.png", "rb"),

prompt="Измени цвет фона на синий",

# Параметры безопасности (безопасность детей изменить нельзя)

safety_settings={

"harm_block_threshold": "BLOCK_MEDIUM_AND_ABOVE",

# Следующие настройки не влияют на безопасность детей, она всегда на максимуме

# "child_safety": не настраивается

}

)

Посмотреть полный код конфигурации безопасности

"""

Пример полной конфигурации безопасности Nano Banana Pro

Демонстрация настраиваемых и неизменяемых параметров

"""

from openai import OpenAI

import base64

# Инициализация клиента

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Используем единый интерфейс APIYI

)

def safe_image_edit(image_path: str, prompt: str) -> dict:

"""

Функция безопасного редактирования изображений

с полной обработкой ошибок

"""

try:

# Чтение изображения

with open(image_path, "rb") as f:

image_data = f.read()

# Отправка запроса на редактирование

response = client.images.edit(

model="nano-banana-pro",

image=image_data,

prompt=prompt,

n=1,

size="1024x1024",

response_format="url"

)

return {

"success": True,

"url": response.data[0].url

}

except Exception as e:

error_message = str(e)

# Обработка ошибки IMAGE_SAFETY

if "IMAGE_SAFETY" in error_message:

return {

"success": False,

"error": "IMAGE_SAFETY",

"message": "На фото обнаружен человек, похожий на несовершеннолетнего, обработка невозможна",

"suggestion": "Пожалуйста, используйте фото только со взрослыми людьми"

}

# Обработка ошибки PROHIBITED_CONTENT

if "PROHIBITED_CONTENT" in error_message:

return {

"success": False,

"error": "PROHIBITED_CONTENT",

"message": "Обнаружен запрещенный контент",

"suggestion": "Пожалуйста, проверьте изображение на соответствие правилам"

}

# Другие ошибки

return {

"success": False,

"error": "UNKNOWN",

"message": error_message

}

# Пример использования

result = safe_image_edit("photo.jpg", "Замени фон на пляж")

if result["success"]:

print(f"Успешно: {result['url']}")

else:

print(f"Ошибка: {result['message']}")

print(f"Совет: {result.get('suggestion', 'Попробуйте еще раз')}")

🚀 Быстрый старт: Рекомендуем использовать платформу APIYI (apiyi.com) для быстрого знакомства с Nano Banana Pro. Платформа предоставляет готовые API-интерфейсы, не требующие сложной настройки, и подробную документацию по обработке ошибок.

Лучшие практики по соблюдению правил использования Nano Banana Pro

Теперь, когда мы разобрались с механизмами безопасности, давайте изучим, как правильно использовать Nano Banana Pro, чтобы соответствовать всем правилам.

Чек-лист перед началом разработки

Прежде чем интегрировать Nano Banana Pro в свое приложение, проверьте следующие пункты:

| Элемент проверки | Обязательность | Способ проверки | Рекомендация по комплаенсу |

|---|---|---|---|

| Проверка возраста пользователя | Обязательно | Верификация при регистрации | Ограничение 18+ |

| Источник изображения | Обязательно | Соглашение о загрузке | Требовать от пользователя подтверждение авторских прав |

| Ограничение сценариев использования | Рекомендуется | Дизайн функций | Четко информировать об ограничениях использования |

| Механизм обработки ошибок | Обязательно | Реализация в коде | Дружелюбные уведомления для пользователя |

| Процесс модерации контента | Рекомендуется | Бэкенд-система | Механизм ручной проверки |

Лучшие практики для уведомлений пользователя

Чтобы не вводить пользователей в заблуждение, рекомендуем добавить в приложение следующие подсказки:

Подсказка при загрузке:

温馨提示: 为保护未成年人安全,包含儿童形象的图片将无法进行编辑处理。

请确保上传的图片中所有人物均为成年人。

Уведомление об ошибке:

抱歉,该图片无法处理。

原因: 系统检测到图片可能包含未成年人形象。

建议: 请使用仅包含成年人的图片,或移除图片中的未成年人部分后重试。

Рекомендации по дизайну приложения

-

Четко определите сценарии использования

- Укажите в документации продукта, что обработка фотографий детей не поддерживается.

- Включите соответствующие пункты в пользовательское соглашение.

-

Оптимизируйте пользовательский опыт (UX)

- Предоставляйте понятные описания ошибок.

- Объясняйте причину ограничения вместо того, чтобы просто показывать код ошибки.

- Предлагайте возможные варианты решения проблемы.

-

Подготовка документации по комплаенсу

- Сохраняйте логи вызовов API.

- Фиксируйте случаи срабатывания фильтров безопасности.

- Создайте механизм отчетности о нештатных ситуациях.

💰 Оптимизация затрат: Для проектов, требующих частого обращения к API редактирования изображений, можно рассмотреть платформу APIYI (apiyi.com). Она предлагает гибкие тарифы и более выгодные цены, что отлично подходит для небольших команд и индивидуальных разработчиков.

Часто задаваемые вопросы

Q1: Почему IMAGE_SAFETY срабатывает на фото явно взрослых людей?

Nano Banana Pro придерживается консервативной стратегии при определении возраста. Если у системы недостаточно уверенности в возрасте человека на фото, она по умолчанию классифицирует его как несовершеннолетнего для обеспечения безопасности.

Возможные причины срабатывания:

- Моложавые черты лица (так называемый «baby face»).

- Освещение или ракурс на фото, затрудняющие оценку.

- Использование фильтров в стиле аниме или мультфильмов.

Рекомендуется использовать фотографии с четко видимыми чертами лица. Через платформу APIYI (apiyi.com) можно получить более подробную диагностическую информацию об ошибках.

Q2: Можно ли исправить ошибку IMAGE_SAFETY, изменив параметры?

Нет. Защита, связанная с безопасностью детей, является основным механизмом Nano Banana Pro и относится к категории нерегулируемых мер защиты.

Это отраслевой стандарт, разработанный Google в сотрудничестве с организациями по защите детей. Никакие параметры или конфигурации API не позволяют обойти это ограничение. Это не баг, а намеренно спроектированная функция безопасности.

Если вам нужно обрабатывать большое количество изображений, рекомендуем проводить предварительный отбор и использовать тестовый баланс на платформе APIYI (apiyi.com) для проверки соответствия изображений правилам.

Q3: Как понять, вызовет ли изображение срабатывание фильтров безопасности?

Рекомендуется провести предварительную проверку перед основной обработкой:

- Убедитесь, что на изображении нет явно несовершеннолетних лиц.

- Избегайте использования сцен, типичных для детей (школы, детские площадки и т.д.).

- Сначала протестируйте превью-версию в низком разрешении.

- Создайте внутренний процесс модерации для фильтрации подозрительных изображений.

Q4: Бывают ли ложные срабатывания при детектировании CSAM?

Технология сопоставления хэшей работает по базам данных известных материалов CSAM, поэтому вероятность ложного срабатывания крайне мала. Однако ИИ-определение возраста может ошибаться.

Если вы уверены, что контент соответствует правилам, но он все равно отклоняется, скорее всего, дело в консервативной стратегии определения возраста. Система спроектирована по принципу «лучше ошибочно отклонить нормальный контент, чем пропустить что-то потенциально опасное для детей».

Q5: Распространяются ли ограничения на аниме или виртуальных персонажей?

Да, механизмы защиты Nano Banana Pro также применимы к аниме, иллюстрациям и виртуальным персонажам.

Если виртуальный персонаж выглядит как несовершеннолетний, это также вызовет срабатывание фильтра IMAGE_SAFETY. Рекомендуется использовать изображения персонажей, которые выглядят явно взрослыми, или избегать операций редактирования, затрагивающих людей.

Итоги и рекомендации

5 ключевых механизмов защиты несовершеннолетних в Nano Banana Pro демонстрируют, насколько серьезно индустрия ИИ относится к безопасности детей:

| Ключевой аспект | Описание |

|---|---|

| Основной принцип | Safety by Design (безопасность на этапе проектирования), безопасность детей превыше всего |

| Техническая архитектура | Многоуровневая защита: хеш-детектирование + ИИ-классификаторы + фильтрация контента |

| Невозможность обхода | Ограничения безопасности детей нельзя изменить или отключить через какие-либо параметры |

| Отраслевые стандарты | Разработано в сотрудничестве с такими организациями, как Thorn и NCMEC |

| Рекомендации по комплаенсу | Четко информируйте пользователей об ограничениях и предоставляйте понятные сообщения об ошибках |

Рекомендации к действию

- Разработчикам: предусмотрите в логике приложения обработку ответов, связанных с ограничениями безопасности.

- Продакт-менеджерам: включите механизмы защиты детей в план проектирования функционала продукта.

- Операционным специалистам: подготовьте стандартные скрипты ответов на запросы пользователей, касающиеся данных ограничений.

Рекомендуем использовать APIYI (apiyi.com) для быстрого тестирования функций Nano Banana Pro и понимания реальных границ безопасности.

Справочные материалы:

-

Google AI Safety Policies: официальная документация по политике безопасности

- Ссылка:

ai.google.dev/gemini-api/docs/safety-policies

- Ссылка:

-

Thorn — Safety by Design: инициатива по технологиям детской безопасности

- Ссылка:

thorn.org/safety-by-design

- Ссылка:

-

NCMEC Reports: отчеты Национального центра по делам пропавших и эксплуатируемых детей

- Ссылка:

missingkids.org/gethelpnow/csam-reports

- Ссылка:

📝 Автор: APIYI Team | 🌐 Техническое сообщество: apiyi.com

Этот материал подготовлен и опубликован технической командой APIYI. Если у вас возникли вопросы, обращайтесь за технической поддержкой на APIYI (apiyi.com).