Im zweiten Quartal 2026 hat sich auf dem Markt für Bilderzeugung eine beispiellose „Zwillingsstern“-Konstellation entwickelt:

- Nano Banana 2 (Gemini 3.1 Flash Image) wurde am 26. Februar veröffentlicht und fordert mit Flash-Geschwindigkeit die Bildqualität der Pro-Klasse heraus – Bilder werden in nur 1-2 Sekunden generiert.

- GPT-Image-2 erschien am 21. April und setzte mit einem Arena-Ergebnis von 1512 Elo und einer Textgenauigkeit von über 99 % neue Maßstäbe in der gesamten Branche.

Beide Modelle bieten spezifische Vorteile in den beiden Kernbereichen Text-zu-Bild und Bildbearbeitung. Viele Entwickler und Designer stehen bei der Auswahl vor der Frage: „Welches Modell, GPT-Image-2 oder Nano Banana 2, ist besser für mein Unternehmen geeignet?“

Dieser Artikel analysiert basierend auf offiziellen Dokumentationen, den Elo-Rankings der LMArena und realen Geschäftsszenarien die Leistungsunterschiede beider Modelle in 8 Dimensionen, um Ihnen bei der schnellen Entscheidungsfindung zu helfen.

GPT-Image-2 vs. Nano Banana 2: Ein Kurzüberblick der Kernkompetenzen

Verschaffen Sie sich zunächst einen Überblick über die wesentlichen Unterschiede der beiden Modelle anhand der folgenden Vergleichstabelle.

| Vergleichsdimension | GPT-Image-2 (OpenAI) | Nano Banana 2 (Google) |

|---|---|---|

| Veröffentlichungsdatum | 21.04.2026 | 26.02.2026 |

| Basismodell | GPT-5 + O-Series Reasoning | Gemini 3.1 Flash Image |

| Arena Text-zu-Bild Elo | 1512 (#1) | 1360 |

| Arena Einzelbild-Edit Elo | 1513 (#1) | ~1065 |

| Arena Mehrbild-Edit Elo | 1464 (#1) | ~1050 |

| Textgenauigkeit | 99%+ | ca. 93% |

| Generierungsgeschwindigkeit | 3 Sek. (Sofort) | 1-2 Sek. (offiziell) / 4-6 Sek. (gemessen) |

| Max. Auflösung | 2K nativ / 4K Beta | 2K nativ / 4K Pro |

| Unterstützt Inpainting | ✅ Lokale Bearbeitung | ✅ Lokale Bearbeitung |

| Unterstützt Outpainting | ✅ | ✅ |

| Maximales Seitenverhältnis | 3:1 / 1:3 | 4:1 / 1:4 / 8:1 |

| Bilder pro Aufruf | bis zu 8 Bilder | 1 Bild |

| API-Standardpreis | ~$0,04 (Standard) | $0,067 (1K) |

| Batch-API-Rabatt | Kein expliziter Rabatt | 50% Rabatt |

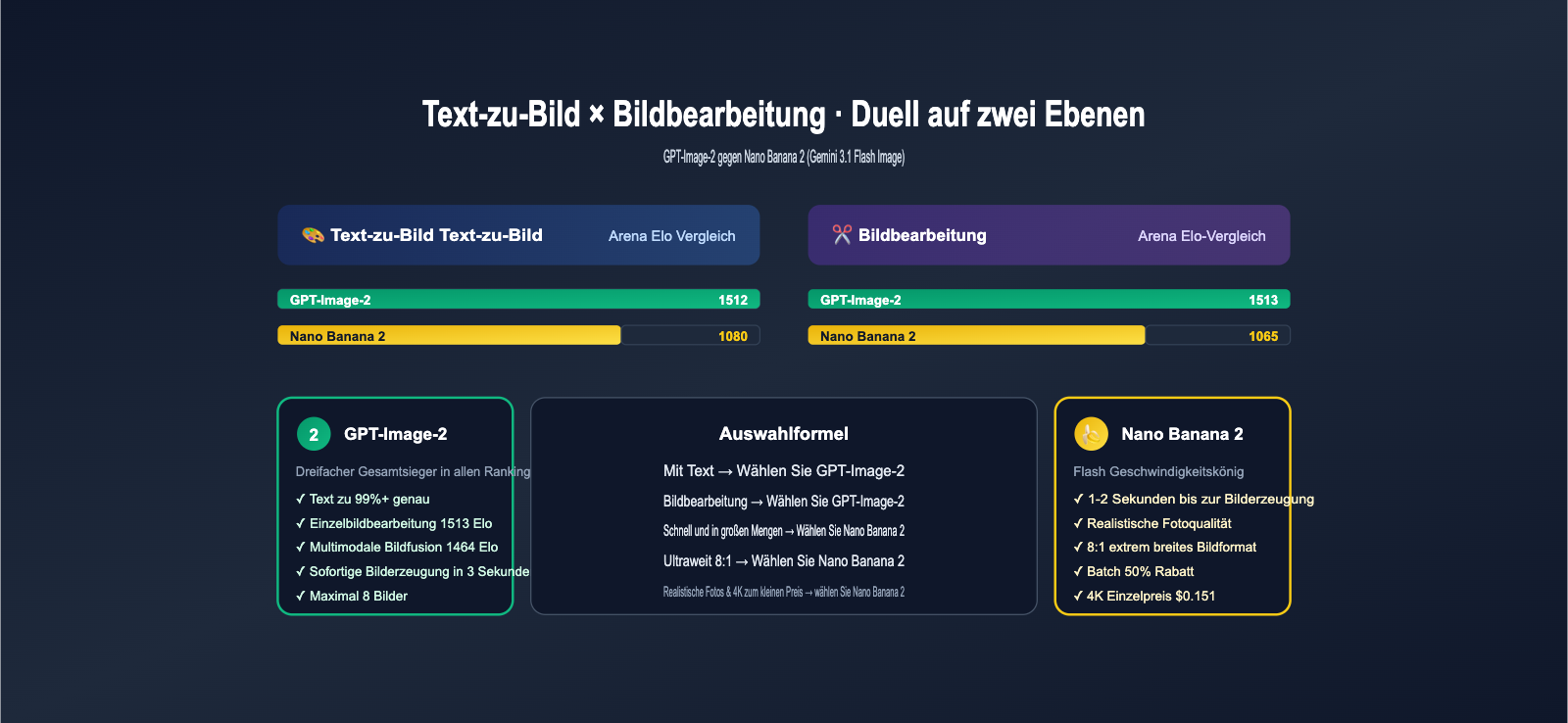

🎯 Kurzfazit: GPT-Image-2 ist bei Textdarstellung, lokaler Bearbeitung und struktureller Schlussfolgerung führend und belegt in allen drei Arena-Rankings den ersten Platz. Nano Banana 2 punktet bei Generierungsgeschwindigkeit, Breitbildformaten und Batch-Kosten, was es ideal für häufige Iterationen und Massenproduktionen macht. Für Teams, die beide Modelle einheitlich testen möchten, empfehlen wir die Nutzung eines API-Proxy-Dienstes wie APIYI (apiyi.com), um beide Modelle über ein Gateway anzubinden und die separate Wartung von OpenAI- und Google-SDKs zu vermeiden.

Dimension 1: Arena Text-zu-Bild-Ranking – Das "1512-Wunder" von GPT-Image-2

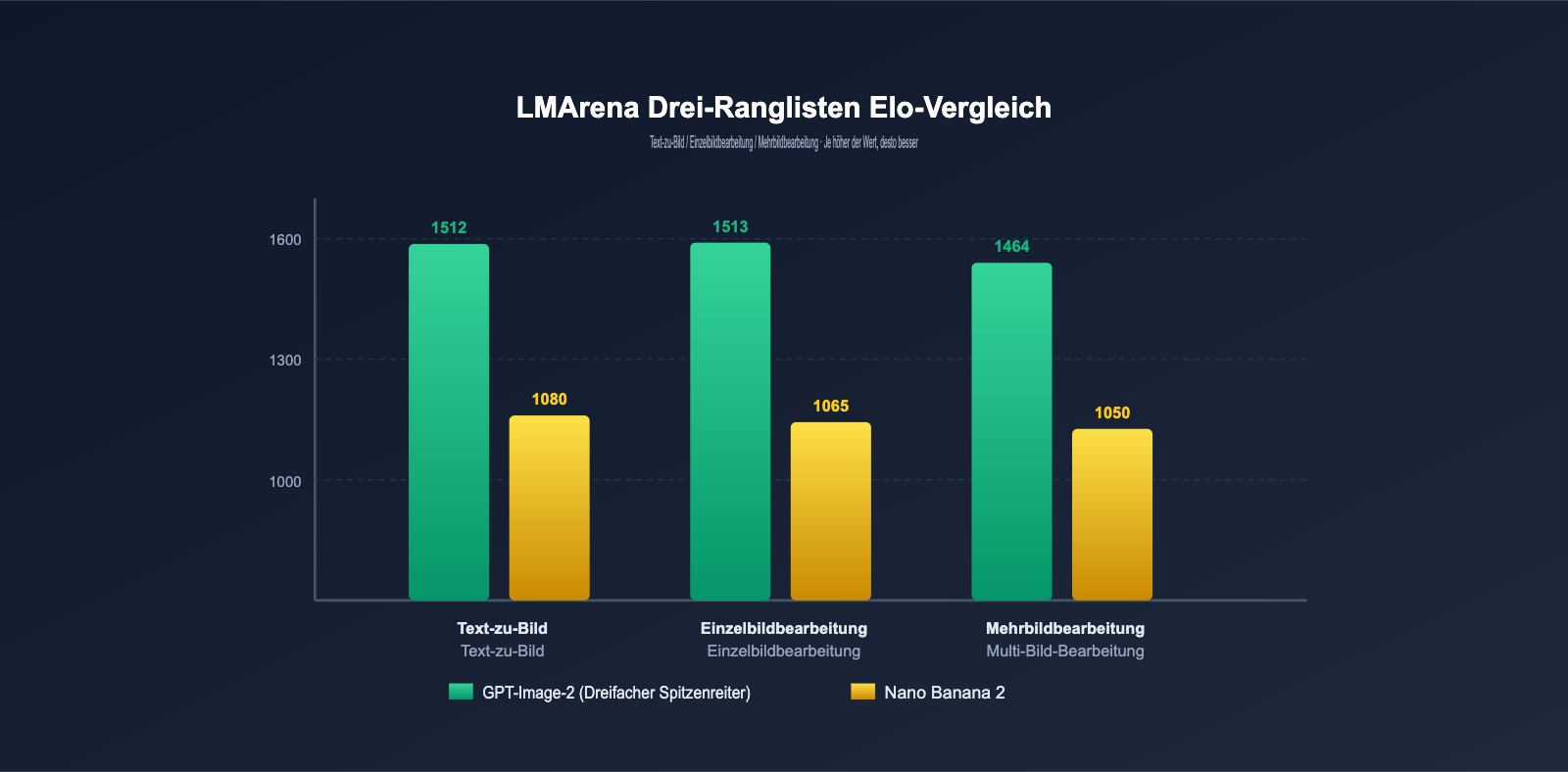

LMArena ist derzeit die maßgebliche Arena für Blindtests, in der globale Nutzer anonym abstimmen und so Elo-Scores generieren. Der Abstand zwischen den beiden Modellen in der Text-zu-Bild-Rangliste ist beträchtlich.

LMArena Text-zu-Bild Elo-Vergleich

| Modell | Elo-Score | Rang | Abstand zum Ersten |

|---|---|---|---|

| GPT-Image-2 | 1512 | #1 | 0 |

| Nano Banana Pro (Gemini 3 Pro Image) | 1360 | #2 | -152 |

| Nano Banana 2 (Gemini 3.1 Flash Image) | ~1080 | #5+ | -432 |

| Midjourney V8 | ~1250 | #3 | -262 |

| FLUX Pro 1.1 | ~1180 | #4 | -332 |

Wichtige Beobachtungen:

- Der Vorsprung von GPT-Image-2 gegenüber Nano Banana 2 (Flash-Version) bei der Bilderzeugung beträgt 432 Elo-Punkte, was fast den größten Abstand in der Geschichte der Arena darstellt.

- Die Flash-Version (Nano Banana 2) ist auf "Geschwindigkeit und Kosten" optimiert, nicht als Flaggschiff für Bildqualität gedacht.

- Beim reinen Vergleich der Bildqualität gewinnt GPT-Image-2 deutlich; beim Preis-Leistungs-Verhältnis hat Nano Banana 2 jedoch klare Vorteile.

Unterschiede in der zugrunde liegenden Technologie

Die Stärken der beiden Modelle basieren auf unterschiedlichen Architekturansätzen:

Der autoregressive Pfad von GPT-Image-2

- Basiert auf der Autoregressive-Architektur von GPT-5, die Bilder im Wesentlichen "Stück für Stück" aufbaut.

- Native Integration von O-Series Reasoning: Das Modell kann zuerst die Eingabeaufforderung verstehen → dann das Layout planen → und schließlich generieren.

- Extrem hohe Fähigkeit zum Verständnis semantischer Strukturen – dies ist der technische Grund für die Textgenauigkeit von über 99%.

Der Flash-Diffusionspfad von Nano Banana 2

- Basiert auf dem Gemini 3.1 Flash Image Diffusionsmodell.

- Strebt nach schnellen Iterationen und fotorealistischer Qualität, was es ideal für die Konzeptentwicklung macht.

- Nutzt das Weltwissen von Gemini und die Websuche, um die Realitätstreue zu erhöhen.

💡 Technische Empfehlung: Wenn Sie präzise Strukturen und lesbaren Text benötigen (Poster, Infografiken, UI), ist der autoregressive Vorteil von GPT-Image-2 besser geeignet. Wenn Sie schnelle Bilder und fotorealistische Ergebnisse benötigen (Konzeptentwürfe, soziale Medien, realistische Fotografie), ist die Flash-Diffusion von Nano Banana 2 die bessere Wahl.

Dimension 2: Bildbearbeitungsfunktionen – GPT-Image-2 punktet erneut

Die Bildbearbeitung (Image Editing / Inpainting) ist eine Kernfunktion beider Modelle, doch auf der speziellen Bestenliste für Bildbearbeitung von LMArena ist der Leistungsunterschied deutlich.

Arena Elo-Werte für Bildbearbeitung

| Bearbeitungstyp | GPT-Image-2 | Nano Banana 2 | Differenz |

|---|---|---|---|

| Einzelbildbearbeitung (Single-Image Edit) | 1513 | ~1065 | +448 |

| Mehrbild-Fusion (Multi-Image Edit) | 1464 | ~1050 | +414 |

GPT-Image-2 ist der dreifache Champion in Text-zu-Bild, Einzelbildbearbeitung und Mehrbildbearbeitung, was ein Novum in der Geschichte der KI-Bildmodelle darstellt.

Vergleich der Bearbeitungsfunktionen

| Bearbeitungsfunktion | GPT-Image-2 | Nano Banana 2 |

|---|---|---|

| Inpainting (lokale Korrektur) | ✅ Präzise Hintergrundbewahrung | ✅ Natürliche Fusion |

| Outpainting (Erweiterung) | ✅ Unterstützt 3:1 Ultra-Wide | ✅ Unterstützt 8:1 Extrem-Breitbild |

| Textbearbeitung (Text im Bild ändern) | ✅ 99 % Genauigkeit | ✅ ca. 90 % |

| Stilübertragung | ✅ Fusion mit Referenzbild | ✅ Fusion mit Referenzbild |

| Objektentfernung | ✅ Feine Bereinigung | ✅ Natürliche Auffüllung |

| Objekthinzufügung | ✅ Automatische Lichtanpassung | ✅ Automatische Lichtanpassung |

| Hintergrundersatz | ✅ Präzise Kanten | ✅ Präzise Kanten |

| Mehrbild-Fusion (Komposition) | ✅ Bis zu 8 Eingabebilder | ✅ Mehrere Referenzbilder |

Testszenarien für die Bearbeitung

Szenario 1: Textänderung bei Produktbildern (Änderung von "V1.0" auf "V2.0" auf einer Verpackung)

- GPT-Image-2: Präziser Textaustausch; Schriftart, Farbe und Reflexionen bleiben perfekt erhalten, keine sichtbaren Inpainting-Nähte.

- Nano Banana 2: Erledigt die Aufgabe, aber die Schriftart driftet gelegentlich ab; erfordert 2–3 Versuche.

Szenario 2: Poster-Outpainting (Erweiterung eines 9:16-Porträtposters auf 21:9)

- GPT-Image-2: Erweiterung bis 3:1, sehr natürliche Komposition.

- Nano Banana 2: Kann bis auf 8:1 extrem breit erweitern, an den Rändern können jedoch vereinzelt doppelte Elemente auftreten.

Szenario 3: Mehrbild-Fusion ("Person A" + "Hintergrund B" + "Kleidung C" zu einem Bild kombinieren)

- GPT-Image-2: 1464 Elo in der Mehrbildbearbeitung; Fusionsqualität und Detailerhalt sind branchenführend.

- Nano Banana 2: Fusionsqualität etwas schwächer, aber 2–3-mal schneller, ideal für schnelle Entwürfe.

🎯 Empfehlung: Für Marken-E-Commerce / Fokus auf Bildqualität wählen Sie GPT-Image-2; für Social-Media-Inhalte / schnelle Iterationen wählen Sie Nano Banana 2. In der Praxis bewährt sich oft ein Workflow: "Erster Entwurf mit Nano Banana 2, finale Feinabstimmung mit GPT-Image-2".

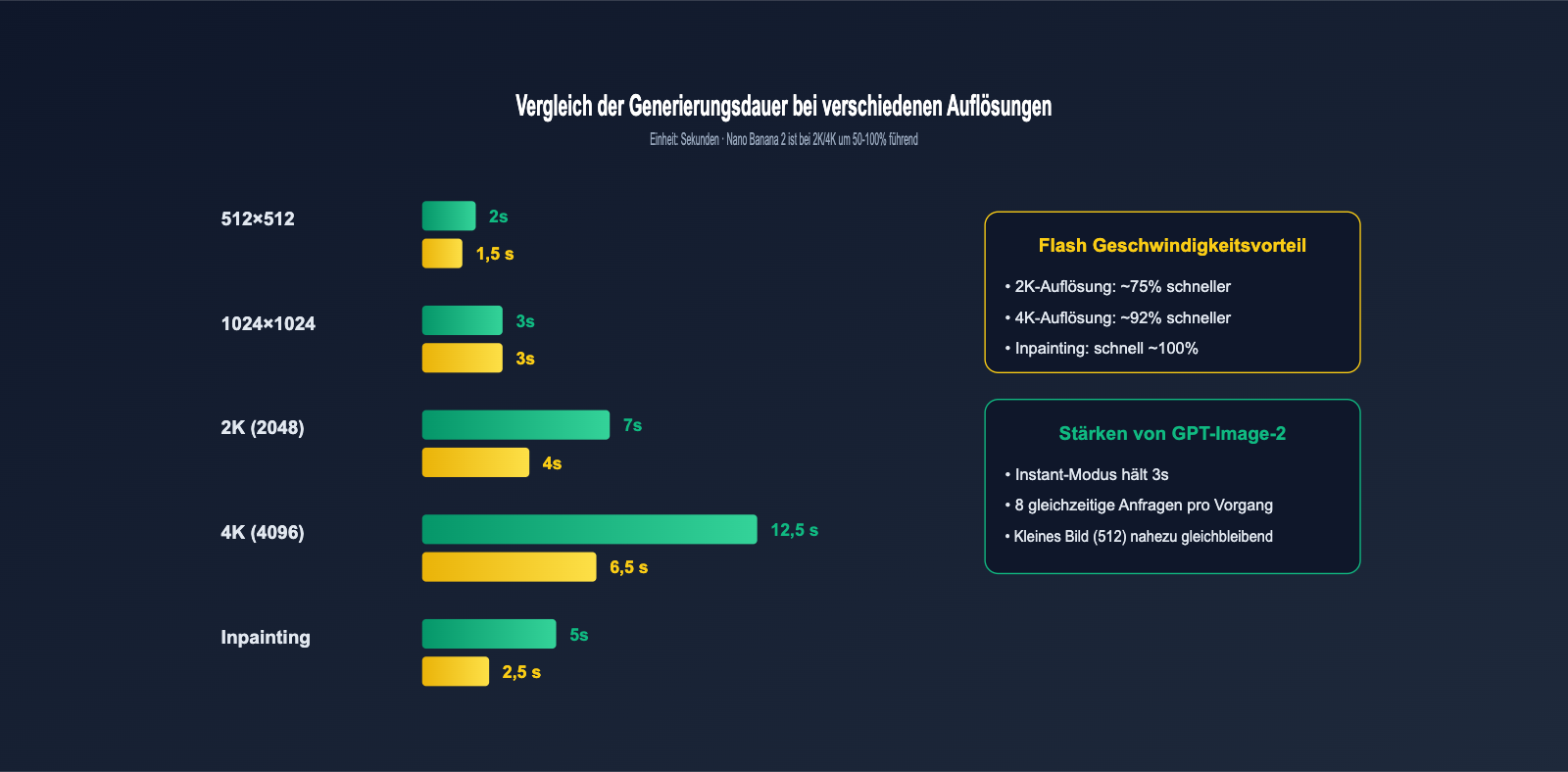

Dimension 3: Generierungsgeschwindigkeit – Nano Banana 2 ist der "Flash"-König

Geschwindigkeit ist das wichtigste Alleinstellungsmerkmal von Nano Banana 2 und die wahre Bedeutung des Namenszusatzes "Flash".

Generierungsdauer bei verschiedenen Auflösungen

| Auflösung | GPT-Image-2 (Instant) | Nano Banana 2 | Geschwindigkeitsfaktor |

|---|---|---|---|

| 512×512 | 2 Sek. | 1–2 Sek. | 1,0–1,5x |

| 1024×1024 | 3 Sek. | 2–4 Sek. | 1,0–1,2x |

| 2K (2048×2048) | 5–8 Sek. | 3–5 Sek. | 1,3–1,6x |

| 4K (4096×4096) | 10–15 Sek. | 5–8 Sek. | 1,7–2,0x |

| Inpainting (Einzelbild) | 4–6 Sek. | 2–3 Sek. | 1,5–2,0x |

Fazit: Bei der Generierung von 2K- und 4K-Bildern ist Nano Banana 2 um 50–100 % schneller. Dies hat erhebliche Auswirkungen auf Teams, die große Mengen an Bildern produzieren (E-Commerce, Content-Fabriken, Stock-Datenbanken).

Parallelisierung und Durchsatz

Nano Banana 2 kann pro Anfrage nur ein Bild generieren, aber aufgrund der extrem schnellen Flash-Architektur ist die Batch-Parallelisierung hervorragend:

- GPT-Image-2: Maximal 8 Bilder pro Anfrage, strengere Parallelisierungslimits.

- Nano Banana 2: 1 Bild pro Anfrage, aber nutzbar mit der Batch-API zu 50 % des Einzelpreises für massenhafte Parallelisierung.

Für Content-Farmen / SaaS-Produkte, die täglich Tausende von Bildern produzieren müssen, bietet die Batch-API von Nano Banana 2 oft ein 3- bis 5-mal besseres Preis-Leistungs-Verhältnis.

# Nano Banana 2 Batch-Parallelisierungsbeispiel

import asyncio

from openai import AsyncOpenAI

client = AsyncOpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI einheitliches Gateway, unterstützt beide Modelle

)

async def gen_one(prompt: str):

resp = await client.images.generate(

model="gemini-3.1-flash-image",

prompt=prompt,

size="1024x1024",

n=1

)

return resp.data[0].url

async def batch_run(prompts: list[str]):

tasks = [gen_one(p) for p in prompts]

return await asyncio.gather(*tasks)

# 50 Prompts parallel ausführen, theoretische Dauer = Dauer eines einzelnen Bildes

prompts = ["...prompt 1...", "...prompt 2...", ...]

results = asyncio.run(batch_run(prompts))

💡 Empfehlung zur Parallelisierung: In Flash-Modell-Szenarien bestimmt die Verbindungspool-Effizienz des API-Proxy-Dienstes direkt die Erfolgsrate. Für Produktionsumgebungen empfehlen wir ein API-Gateway mit Sub-Sekunden-Reaktionszeit und Verbindungspooling, um die Fehlerrate bei Long-Tail-Anfragen unter 0,1 % zu halten.

Dimension 4: Text-Rendering – Der absolute Vorteil von GPT-Image-2

Die Text-Rendering-Fähigkeit ist die „Todeszone“ für Bildmodelle; über Jahre hinweg sind die meisten Modelle genau daran gescheitert. GPT-Image-2 ist das erste kommerzielle Modell, das die 99%-Genauigkeitsmarke durchbrochen hat.

Erstmalige Genauigkeit bei der Generierung verschiedener Sprachen

| Sprache | GPT-Image-2 | Nano Banana 2 | Differenz |

|---|---|---|---|

| Englisch | 99,5%+ | 96% | +3,5pp |

| Chinesisch (V/K) | 98%+ | 90% | +8pp |

| Japanisch (Kanji/Kana) | 97%+ | 85% | +12pp |

| Koreanisch (Hangul) | 96%+ | 82% | +14pp |

| Arabisch (RTL) | 95%+ | 75% | +20pp |

Wichtige Unterschiede:

- Englisch: GPT-Image-2 liegt leicht vorn, im Alltag kaum spürbar.

- Chinesisch: Die Lücke wächst auf 8 Prozentpunkte, was sich deutlich auf Poster und Infografiken auswirkt.

- Nicht-westliche Sprachen (Japanisch/Koreanisch/Arabisch): GPT-Image-2 bietet hier einen massiven Vorsprung.

Auswahlhilfe für textlastige Szenarien

| Szenario | Empfehlung | Grund |

|---|---|---|

| Englische Marketing-Poster | Beide geeignet | Differenz <4pp |

| Chinesische Social-Media-Karten | GPT-Image-2 | Stabile Zeichenform |

| Mehrsprachige Werbung | GPT-Image-2 | Einheitlich hohe Genauigkeit |

| Japanische Anime-Cover | GPT-Image-2 | Stabile Kana- und Kanji-Formen |

| Arabische Werbung | GPT-Image-2 | RTL-Sprachen verformen sich nicht |

| Marken-Logo-Überlagerung | GPT-Image-2 | Schriftarten sind reproduzierbar |

| Reine Kunst ohne Text | Nano Banana 2 | Höhere Geschwindigkeit |

🎯 Empfehlung zur Modellauswahl: Sobald Ihre Bildausgabe lesbaren Text enthält, insbesondere bei CJK- oder RTL-Sprachen, sollten Sie bedingungslos GPT-Image-2 bevorzugen. Nano Banana 2 mag bei der Flash-Geschwindigkeit punkten, aber ein fehlerhafter Text erfordert einen erneuten Durchlauf, was die Gesamtkosten in die Höhe treibt.

Dimension 5: Realismus und Stil – Das Fotogefühl von Nano Banana 2

Obwohl GPT-Image-2 in den Bestenlisten insgesamt führt, behält Nano Banana 2 dank seiner Flash-Diffusionsarchitektur bei realistischer Fotoqualität, filmischer Beleuchtung und Hauttexturen einen einzigartigen Vorteil.

Vergleichsmatrix für Realismus

| Realismus-Dimension | GPT-Image-2 | Nano Banana 2 |

|---|---|---|

| Hauttextur | Eher digitaler Illustrationsstil | Natürliche Porenstruktur |

| Lichtrealismus | Exzellent | Filmreif |

| Tiefenschärfe (Bokeh) | Gut | Nahe an DSLR-Qualität |

| Materialdetails (Metall/Stoff) | Fein | Extrem fein |

| Natürliches Außenlicht | Standard | Exzellent |

| Innenbeleuchtung | Standard | Filmisch |

| Emotionale Ausdruckskraft | Rational | Emotional |

| Künstlerische Stilisierung | Vielfältig | Eher realistisch |

Realistische Szenarien für Nano Banana 2

- 📷 Ersatz für E-Commerce-Fotoshootings: Kleidung, Schuhe, Taschen, Kosmetik

- 🏨 Hotel-/Immobilien-Außen- & Innenaufnahmen

- 🍽️ Food-Fotografie-Stil

- 🎬 Filmplakate / Keyvisuals für Trailer

- 🌅 Reisefotografie / Naturaufnahmen

- 👥 Alltägliche Charakterszenen (keine hochglanzpolierten Kunstfotos)

Kreative Szenarien für GPT-Image-2

- 🎨 Illustrationen / Künstlerisches Rendering

- 🖥️ UI-Prototypen / Mockups

- 📊 Infografiken / Datenvisualisierung

- 📝 Poster + Text-Layout

- 🎭 Comic-Storyboards

- 🧩 Präzises Layout mehrerer Objekte

Dimension 6: Seitenverhältnis und Bildformat – Nano Banana 2 ist extremer

Für superbreite Banner-Anzeigen, vertikale Feeds und lange E-Commerce-Detailbilder bestimmt die Flexibilität des Bildformats direkt die Nutzbarkeit.

| Bildformat-Anforderung | GPT-Image-2 Unterstützungsbereich | Nano Banana 2 Unterstützungsbereich |

|---|---|---|

| Quadratisch 1:1 | ✅ | ✅ |

| Querformat 16:9 | ✅ | ✅ |

| Hochformat 9:16 | ✅ | ✅ |

| Kino 21:9 | ✅ | ✅ |

| Superbreit 3:1 | ✅ (Limit) | ✅ |

| Extrabreit 4:1 | ❌ | ✅ |

| Ultra-Extrabreit 8:1 | ❌ | ✅ |

| Vertikal lang 1:4 | ❌ | ✅ |

Die extremen Breitbildformate 4:1 / 8:1 von Nano Banana 2 sind derzeit branchenweit einzigartig und eignen sich ideal für:

- Superbreite Banner am oberen Rand von Webseiten

- Extrem lange zusammengesetzte Bilder auf Produktdetailseiten

- Horizontale Darstellungen von Zeitstrahlen / Flussdiagrammen

- Riesenplakate für Film- oder Musikfestivals

💡 Empfehlung zum Bildformat: Beide Modelle bewältigen gängige Marketingmaterialien problemlos; wenn jedoch superbreite (über 4:1) oder extrem lange (über 1:4) Formate benötigt werden, ist Nano Banana 2 die einzige Wahl. Bei GPT-Image-2 müssten solche Anforderungen durch nachträgliches Zusammenfügen oder Erweitern gelöst werden, was den Prozess deutlich komplexer macht.

Dimension 7: API-Preise und Kostenoptimierung

Die Preisstrategien beider Modelle unterscheiden sich grundlegend. Ein klares Verständnis hilft Ihnen, 30-50 % Ihrer API-Kosten einzusparen.

Vergleich der offiziellen Preisgestaltung (pro Bild)

| Stufe / Auflösung | GPT-Image-2 | Nano Banana 2 | Günstiger |

|---|---|---|---|

| Low / 1024×1024 | $0.006 | $0.045 | GPT-Image-2 |

| Standard / 1024×1024 | ~$0.04 | $0.067 | GPT-Image-2 |

| High / 1024×1024 | $0.211 | $0.067 | Nano Banana 2 |

| High / 2K | $0.28 | $0.120 | Nano Banana 2 |

| High / 4K | $0.41 | $0.151 | Nano Banana 2 |

| Batch / 1K | Keine | $0.034 | Nano Banana 2 |

| Batch / 4K | Keine | $0.076 | Nano Banana 2 |

Zwei typische Kostenmodelle

Modell A: GPT-Image-2 — "Qualitätsbasierte Preisgestaltung"

- Niedrige Qualitätsstufe extrem günstig ($0.006), ideal für erste Entwürfe in großen Mengen

- Hohe Qualitätsstufe sehr teuer ($0.211+), bei Einzelbildern mit Vorsicht zu genießen

- Keine Batch-Rabatte

Modell B: Nano Banana 2 — "Auflösungsbasierte Preisgestaltung + Batch-Rabatt"

- Preis über alle Stufen stabil zwischen $0.045-$0.151

- Batch-API bietet durchgehend 50 % Rabatt

- Sehr hohe Kosteneffizienz bei der Produktion großer Mengen in 4K

Beispiel für monatliche Kosten (bei 10.000 Bildern pro Monat)

| Szenario | GPT-Image-2 Monatskosten | Nano Banana 2 Monatskosten | Ersparnis |

|---|---|---|---|

| Niedrige Qualität (1K) | $60 (Low) | $340 (Batch) | GPT spart 82% |

| Standard-Ausgabe (1K) | $400 | $340 (Batch) | NB2 spart 15% |

| Hohe Qualität 1K | $2110 | $340 (Batch) | NB2 spart 84% |

| Hohe Qualität 4K | $4100 | $760 (Batch) | NB2 spart 81% |

🎯 Empfehlung zur Kostenoptimierung: Wählen Sie GPT-Image-2 Low für erste Entwürfe und Nano Banana 2 Batch für hochwertige Bilder und Massenproduktion. Eine hybride Steuerung ist die optimale Lösung. Über APIYI (apiyi.com) können Sie beide Modelle mit einem einzigen API-Schlüssel ansteuern und je nach Geschäftsszenario wechseln, ohne Guthaben separat bei OpenAI und Google aufladen zu müssen.

Dimension 8: Compliance, Wasserzeichen und Inhaltssicherheit

Die Ansätze beider Anbieter zur Sicherheitskontrolle generierter Inhalte unterscheiden sich stark, was direkte Auswirkungen auf die Compliance in Unternehmen hat.

| Compliance-Dimension | GPT-Image-2 | Nano Banana 2 |

|---|---|---|

| Sichtbare Wasserzeichen | Keine | Keine |

| Unsichtbare Wasserzeichen | C2PA-Metadaten | SynthID (Google-Patent) |

| Moderations-Strenge | Hoch (löst leicht 400 aus) | Mittel |

| Prominente/Personen des öffentl. Lebens | Strenge Beschränkung | Strenge Beschränkung |

| Marken/Logos | Eher streng | Mittel |

| Inhalte mit Kindern | Strenge Beschränkung | Strenge Beschränkung |

| NSFW / Gewalt | Vollständig verboten | Vollständig verboten |

| Historische Persönlichkeiten | Eher locker | Eher locker |

Praxistest der Moderations-Trigger

Tests mit derselben Eingabeaufforderung zeigen:

- GPT-Image-2: Wenn die Eingabeaufforderung Begriffe wie „Frau, Mode, Badebekleidung“ enthält, liegt die Wahrscheinlichkeit für einen

moderation_blocked400-Fehler bei ca. 8 %. - Nano Banana 2: Bei gleicher Eingabeaufforderung liegt die Fehlerrate bei ca. 3 %, die Prüfung ist also großzügiger.

Das bedeutet, dass für Bereiche wie Mode, Beauty, Fitness oder medizinische Ästhetik die Genehmigungsrate bei Nano Banana 2 höher ist, jedoch eine sorgfältigere interne Inhaltsprüfung erforderlich bleibt.

💡 Compliance-Empfehlung: Für Unternehmensszenarien wird dringend empfohlen, die offiziellen unsichtbaren Wasserzeichen (C2PA oder SynthID) beizubehalten. Wenn Sie feststellen, dass GPT-Image-2 häufig 400-Moderationsfehler zurückgibt, sollten Sie in Betracht ziehen, das entsprechende Szenario auf Nano Banana 2 umzustellen oder die Anleitungen zur Umformulierung der Eingabeaufforderung in der APIYI-Dokumentation (apiyi.com) zu konsultieren.

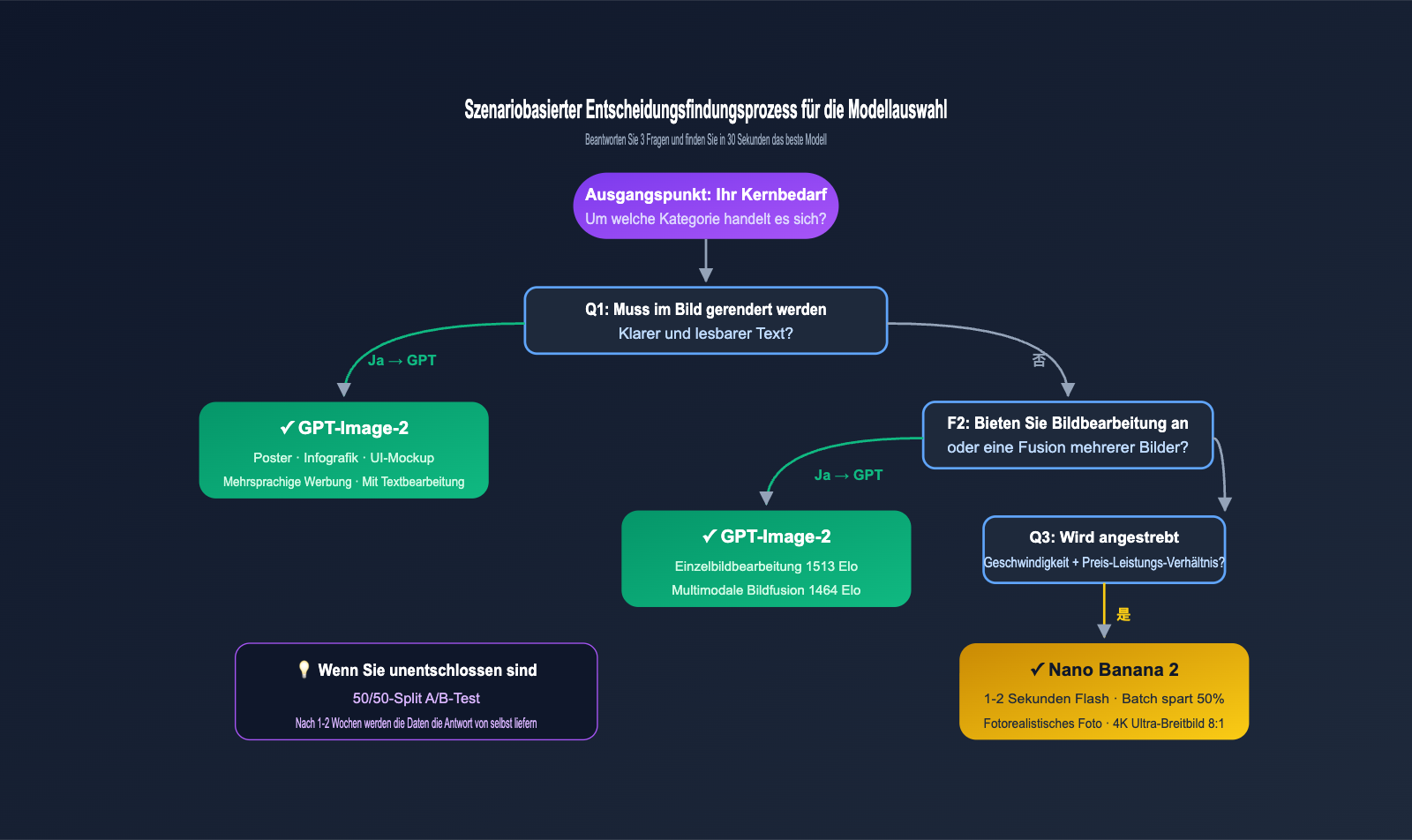

Entscheidungsmatrix für die Szenario-Auswahl

Basierend auf den oben genannten 8 Dimensionen finden Sie hier unsere Empfehlungen für gängige Geschäftsszenarien.

| Geschäftsszenario | Erste Wahl | Alternative | Hauptgrund |

|---|---|---|---|

| Marketing-Poster mit Text | GPT-Image-2 | NB2 Fine-Tuning | 99 % Textgenauigkeit |

| E-Commerce Produktbild-Bearbeitung | GPT-Image-2 | – | Einzelbild-Bearbeitung 1513 Elo |

| E-Commerce Models / Bekleidung | Nano Banana 2 | NB Pro | Realismus + Geschwindigkeit |

| Social Media Content | Nano Banana 2 Batch | – | Kostengünstig + schnell |

| Infografiken / Datenvisualisierung | GPT-Image-2 | – | Schlussfolgerung + Text |

| 4K Ultra-Wide Banner (8:1) | Nano Banana 2 | – | Exklusive Unterstützung |

| Multi-Bild-Synthese | GPT-Image-2 | – | Multi-Bild-Bearbeitung 1464 Elo |

| Echtzeit-KI-Editor | Nano Banana 2 | GPT Instant | 1-2 Sek. Antwortzeit |

| Marken-VI-System | GPT-Image-2 | – | Stabile LOGO-Darstellung |

| Künstlerische Stilisierung | Je nach Bedarf | – | A/B-Test entscheidet |

| Massenhafte Konzept-Exploration | Nano Banana 2 Batch | – | 50 % Rabatt |

| Hochwertiges 4K Fine-Tuning | Nano Banana 2 | – | Niedrigerer Stückpreis |

Drei Strategien für die Misch-调度

Strategie A: Fokus auf Text + Struktur (Markenführung, Werbung, B2B SaaS)

- 90 % Traffic → GPT-Image-2 (Text-zu-Bild + Bearbeitung)

- 10 % Traffic → Nano Banana 2 (Großformat-Realismus, Ultra-Wide)

Strategie B: Fokus auf Geschwindigkeit + Kosten (B2C KI-Tools, Content-Fabriken, kreative Exploration)

- 80 % Traffic → Nano Banana 2 Batch (schnelle Stapelverarbeitung)

- 20 % Traffic → GPT-Image-2 (abschließendes Fine-Tuning + Text)

Strategie C: Dualer A/B-Test (Neue Produkte, datengetriebene Teams)

- 50/50-Aufteilung, statistische Erfassung von Klickraten, Downloadraten und Nachbearbeitungsraten

- Entscheidung für das Hauptmodell basierend auf Daten; Szenario-Präferenzen zeigen sich meist innerhalb von 1-2 Wochen

🎯 Technische Empfehlung: Alle drei Strategien erfordern den Modellwechsel innerhalb desselben SDKs. Wir empfehlen die Verwendung eines API-Proxy-Dienstes, der das OpenAI-Protokoll unterstützt (wie APIYI apiyi.com), um die

base_urlauf ein einheitliches Gateway zu leiten und über dasmodel-Feld zwischengpt-image-2/gemini-3.1-flash-imagezu wechseln, ohne die API-Schlüssel von OpenAI und Google AI Studio separat verwalten zu müssen.

Schnelleinstieg: Zwei Modelle mit demselben Code aufrufen

Einheitliche Python-Aufrufvorlage

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI einheitliches Gateway

)

def generate(model: str, prompt: str, size="1024x1024", quality="high"):

"""Kapselung der einheitlichen Schnittstelle für Text-zu-Bild, nahtloser Wechsel zwischen zwei Modellen"""

resp = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=1

)

return resp.data[0].url

# Vergleich beider Modelle mit demselben Prompt

prompt = "A modern tech startup poster with text 'Launch 2026', minimalist style"

url_gpt = generate("gpt-image-2", prompt)

url_nb2 = generate("gemini-3.1-flash-image", prompt)

print(f"GPT-Image-2: {url_gpt}")

print(f"Nano Banana 2: {url_nb2}")

Beispiel für Bildbearbeitung (Inpainting)

import base64

from pathlib import Path

def load_image_b64(path: str) -> str:

return base64.b64encode(Path(path).read_bytes()).decode()

def edit_image(model: str, image_path: str, mask_path: str, prompt: str):

"""Lokale Bearbeitung eines bestehenden Bildes (Inpainting)"""

resp = client.images.edit(

model=model,

image=open(image_path, "rb"),

mask=open(mask_path, "rb"),

prompt=prompt,

size="1024x1024",

n=1

)

return resp.data[0].url

# Dasselbe Produktbild, Textanpassung mit beiden Modellen

edit_prompt = "Change the text on the box from 'V1.0' to 'V2.0', keep style"

url_gpt_edit = edit_image("gpt-image-2", "product.png", "mask.png", edit_prompt)

url_nb2_edit = edit_image("gemini-3.1-flash-image", "product.png", "mask.png", edit_prompt)

Node.js-Version

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://vip.apiyi.com/v1",

});

async function compareModels(prompt) {

const [gpt, nb2] = await Promise.all([

client.images.generate({ model: "gpt-image-2", prompt, size: "1024x1024" }),

client.images.generate({ model: "gemini-3.1-flash-image", prompt, size: "1024x1024" }),

]);

return { gpt: gpt.data[0].url, nb2: nb2.data[0].url };

}

const result = await compareModels("A cyberpunk city at night, neon signs");

console.log(result);

💡 Integrationshinweis: Beide Modelle nutzen dasselbe OpenAI-Standard-SDK. Zum Wechseln muss lediglich der

model-String angepasst werden, die Parameterstruktur bleibt identisch. Für Teams mit A/B-Test-Anforderungen ist dies der kürzeste Weg, um die Wechselkosten auf Null zu senken.

Häufig gestellte Fragen (FAQ)

1. Sind Nano Banana 2 und Nano Banana Pro dasselbe?

Nein. Nano Banana 2 = Gemini 3.1 Flash Image (Flash-Version, geschwindigkeitsoptimiert); Nano Banana Pro = Gemini 3 Pro Image (Pro-Version, qualitätsoptimiert). Die Positionierung unterscheidet sich:

- Benötigen Sie höchste Qualität + 14 Referenzbilder: Wählen Sie Nano Banana Pro.

- Benötigen Sie höchste Geschwindigkeit + niedrigste Batch-Kosten: Wählen Sie Nano Banana 2.

- Unsicher bei der Wahl: Testen Sie zuerst mit Nano Banana 2 und steigen Sie bei unzureichender Qualität auf Pro um.

2. Ist GPT-Image-2 bei der Bildbearbeitung wirklich besser als Nano Banana 2?

In den Bestenlisten für LMArena Einzelbildbearbeitung (1513 vs 1065) und Mehrbildbearbeitung (1464 vs 1050) hat GPT-Image-2 einen deutlichen Vorsprung. Bei der tatsächlichen Batch-Bearbeitungsgeschwindigkeit ist Nano Banana 2 jedoch 50–100 % schneller. Wenn Sie also maximale Bearbeitungsqualität suchen, wählen Sie GPT-Image-2; für schnelle Batch-Bearbeitung ist Nano Banana 2 die bessere Wahl.

3. Warum liegt der Elo-Wert für Text-zu-Bild bei Nano Banana 2 nur bei 1080, obwohl es sich leistungsstark anfühlt?

Der Arena-Elo-Wert basiert auf relativen Präferenzen in Blindtests, bei denen normale Nutzer die strukturelle Präzision von GPT-Image-2 bevorzugen. Im Workflow professioneller Designer ist die schnelle Iterationsfähigkeit von Nano Banana 2 jedoch oft wertvoller als ein "perfektes Bild beim ersten Versuch". Ein Elo-Wert ist nicht gleichbedeutend mit der "Praxistauglichkeit".

4. Wie lassen sich diese beiden APIs im Inland stabil aufrufen?

Offizielle APIs sind für Nutzer im Inland oft instabil. Wir empfehlen die Anbindung über den API-Proxy-Dienst von APIYI (apiyi.com) mit optimierten Leitungen. Dies ist kompatibel mit dem OpenAI-Standard-SDK, deckt sowohl gpt-image-2 als auch gemini-3.1-flash-image ab, bietet Latenzen im Sub-Sekunden-Bereich und eine unternehmensweite SLA.

5. Sind die Inpainting-Schnittstellen beider Modelle identisch?

Beide sind mit der Standard-Schnittstelle client.images.edit(image, mask, prompt) von OpenAI kompatibel, die Parameterstruktur ist exakt gleich. Über das Proxy-Gateway können Sie denselben Code für beide Modelle ausführen und die Ergebnisse vergleichen, ohne den Request-Body anpassen zu müssen.

6. Wie nutze ich den 50%-Rabatt der Batch-API für Nano Banana 2?

Die Batch-API eignet sich für Nicht-Echtzeit-Szenarien, bei denen Anfragen innerhalb von 24 Stunden gesammelt verarbeitet werden. Markieren Sie beim Aufruf den Endpunkt oder Modellnamen mit batch, z. B. gemini-3.1-flash-image-batch. Bei der Anbindung über APIYI (apiyi.com) wird der Batch-Rabatt automatisch angewendet, ohne dass eine manuelle Beantragung erforderlich ist.

7. Was tun bei einem 400-Fehler (Moderation) bei GPT-Image-2?

Häufige Ursachen: Der Prompt enthält Prominente, Markennamen, Gewalt oder sensible Begriffe. Drei Lösungsansätze:

- Prompt umschreiben und sensible Begriffe vermeiden.

- Den Prompt auf Nano Banana 2 testen (die Moderationsstrategien unterscheiden sich leicht).

- Die spezifische Dokumentation von APIYI (apiyi.com) zur Fehlerbehebung bei der Moderation konsultieren.

8. Wird es in Zukunft Nano Banana 3 oder GPT-Image-3 geben?

Basierend auf dem Iterationszyklus von Google und OpenAI ist für die zweite Jahreshälfte 2026 mit der nächsten Modellgeneration zu rechnen. Wir empfehlen: Nicht warten, sondern jetzt diese beiden Modelle nutzen und die API-Anbindung standardisieren (OpenAI-SDK-kompatibles Format). So werden die Kosten für einen zukünftigen Modellwechsel minimiert.

Fazit: Das Zeitalter der „Zwei-Modell-Arbeitsteilung“ bei Text-zu-Bild und Bildbearbeitung

Nach einem systematischen Vergleich über 8 Dimensionen hinweg lassen sich drei klare Schlussfolgerungen ziehen:

-

GPT-Image-2 ist der Alleskönner für Text-zu-Bild und Bildbearbeitung. Es belegt in allen drei Arena-Bestenlisten den ersten Platz und hat insbesondere bei der Text-Wiedergabe, strukturellen Schlussfolgerungen und der Fusion mehrerer Bilder einen generationsübergreifenden Vorsprung aufgebaut. Es eignet sich ideal für Branding, UI-Design, Infografiken und präzise Bearbeitungsszenarien.

-

Nano Banana 2 ist der König der Flash-Geschwindigkeit und des Preis-Leistungs-Verhältnisses. Es bietet signifikante Vorteile bei der Generierungsgeschwindigkeit für große Bilder, extrem breiten Formaten und Batch-Kosten. Damit ist es die erste Wahl für Content-Fabriken, soziale Medien, Echtzeit-Bearbeitung und realistische Fotografie.

-

Die Arbeitsteilung zwischen zwei Modellen ist die optimale Lösung für 2026. Kein einzelnes Modell kann „alles abdecken“. Durch ein szenariobasiertes Routing lassen sich die Gesamtkosten minimieren und die Ausgabequalität maximieren.

Für Teams, die ohne Migrationsaufwand und ohne Lernkurve schnell mit beiden Modellen starten möchten, empfehlen wir die zentrale Anbindung über die Plattform APIYI (apiyi.com). Mit nur einem API-Schlüssel, einem OpenAI-Standard-SDK und einer base_url können Sie nahtlos zwischen gpt-image-2 und gemini-3.1-flash-image je nach Geschäftsszenario wechseln und dabei von stabilen inländischen Verbindungen sowie Mengenrabatten profitieren.

🎯 Abschließende Empfehlung: Teams, die noch kein Modell angebunden haben, sollten sich bei APIYI (apiyi.com) registrieren. Lassen Sie denselben Code 30 Vergleichsbilder generieren (10x Text-zu-Bild + 10x Einzelbildbearbeitung + 10x Bildfusion). Lassen Sie die Daten sprechen – innerhalb von 30 Minuten werden Sie wissen, welches Modell Ihr Hauptmodell sein sollte.

Autor: APIYI Technik-Team | apiyi.com

Veröffentlichungsdatum: 24.04.2026

Technischer Austausch: Besuchen Sie APIYI (apiyi.com), um die neuesten KI-Großes Sprachmodell-API-Dienste zu erhalten. Wir unterstützen die einheitliche Anbindung von führenden Anbietern wie OpenAI, Google und Anthropic und decken alle Szenarien ab, einschließlich Text-zu-Bild, Bildbearbeitung, Videogenerierung und Textdialoge.