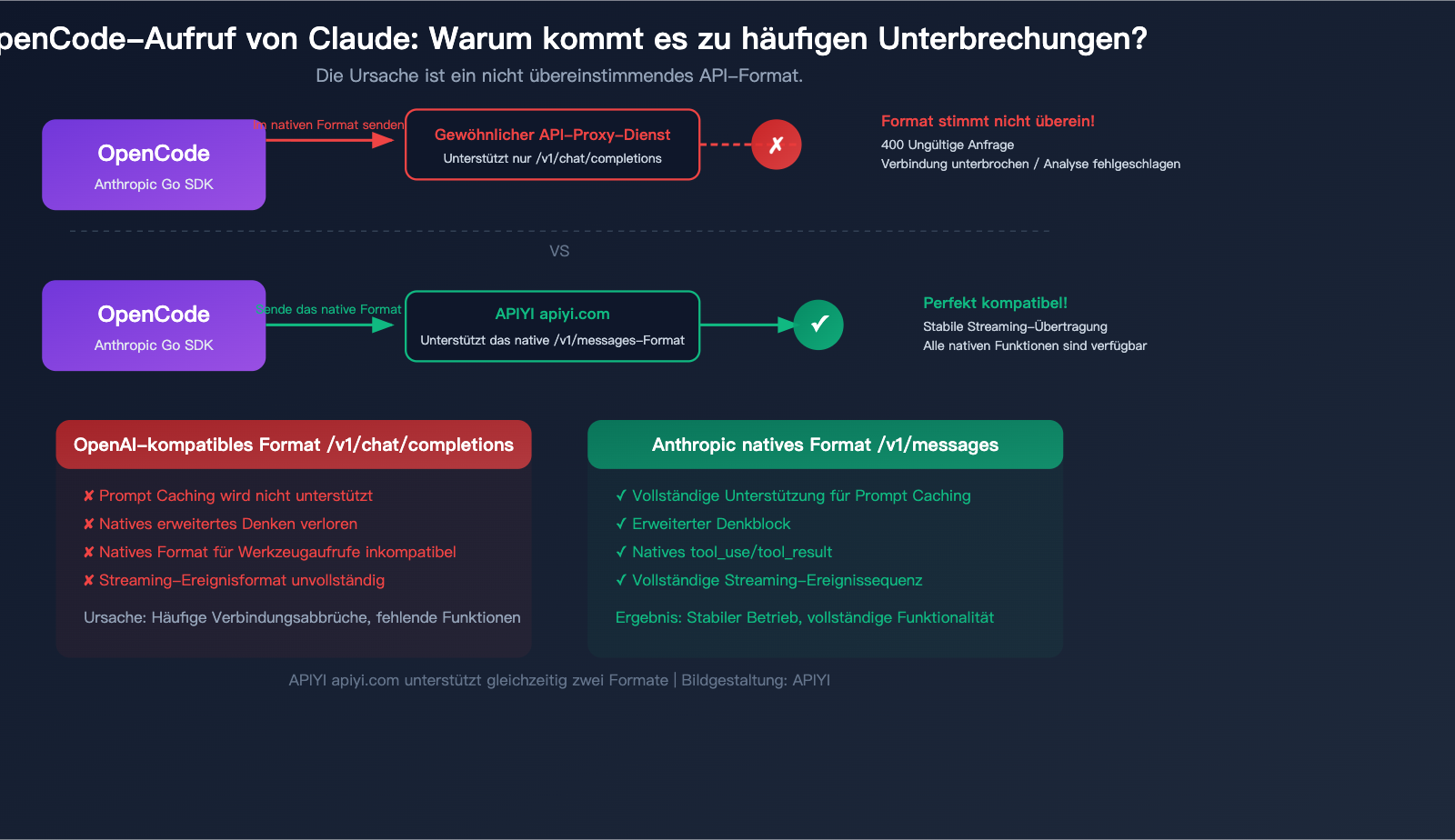

„Warum bricht meine Verbindung zu Claude in OpenCode ständig ab?“ – Das ist das größte Ärgernis für viele Entwickler, die OpenCode (jetzt in Crush umbenannt) nutzen, um Claude-Modelle einzubinden. Der Grund dafür ist eigentlich ganz simpel: OpenCode verwendet das native SDK von Anthropic für den Aufruf von Claude, während viele API-Proxy-Dienste nur das OpenAI-kompatible Format unterstützen. Diese Formatinkompatibilität führt zu häufigen Fehlermeldungen und Verbindungsabbrüchen.

Kernnutzen: Nach dem Lesen dieses Artikels verstehen Sie die zugrunde liegende Architektur von OpenCode bei der Einbindung von Claude, die drei häufigsten Ursachen für Verbindungsabbrüche und die Komplettlösung über die native Anthropic-Schnittstelle von APIYI.

Was ist OpenCode: Von OpenCode zu Crush

OpenCode ist ein KI-gestützter Coding-Assistent für das Terminal, der auf der Programmiersprache Go basiert und ein elegantes TUI (Terminal User Interface) mit dem Bubble-Tea-Framework nutzt. Das Projekt erreichte über 11.600 Sterne auf GitHub und wurde später vom Charm-Team übernommen, wo es in Crush umbenannt wurde (charmbracelet/crush, über 22.200 Sterne).

| Projektinformationen | Details |

|---|---|

| Ursprünglicher Name | OpenCode (opencode-ai/opencode) |

| Aktueller Name | Crush (charmbracelet/crush) |

| Entwicklungssprache | Go |

| Benutzeroberfläche | TUI (Bubble Tea) |

| GitHub Stars | 22.200+ (Crush) |

| Unterstützte KI-Anbieter | Anthropic, OpenAI, Gemini, Groq, OpenRouter, xAI, Bedrock, Azure |

| Tool-System | Dateioperationen, Bash, Grep, Glob, LSP, MCP |

| Open-Source-Lizenz | MIT |

Hauptunterschiede zwischen OpenCode, Claude Code und Aider

| Merkmal | OpenCode/Crush | Claude Code | Aider |

|---|---|---|---|

| Multi-Anbieter-Support | 7+ Anbieter (native SDKs) | Nur Anthropic | Multi-Anbieter |

| API-Format | Natives Format der Anbieter | Anthropic-nativ | Hauptsächlich OpenAI-kompatibel |

| Claude-Aufruf | Anthropic SDK nativ | Anthropic SDK nativ | OpenAI-kompatibles Format |

| Erweitertes Denken | Bedingte Auslösung (inkl. "think") | Integrierte Unterstützung | Modellabhängig |

| MCP-Unterstützung | Ja | Ja | Nein |

| UI | TUI (grafische Oberfläche) | CLI + TUI | Nur CLI |

Wichtiger Unterschied: OpenCode verwendet für jeden KI-Anbieter das native SDK und greift nicht auf ein einheitliches OpenAI-kompatibles Format zurück. Das bedeutet, dass beim Aufruf von Claude die native Messages API von Anthropic (/v1/messages) verwendet wird und nicht die Chat Completions API von OpenAI (/v1/chat/completions).

🎯 Kernhinweis: Genau hier liegt die Ursache des Problems – wenn Ihr API-Proxy-Dienst nur die Schnittstelle

/v1/chat/completionsbereitstellt, kann das native Anthropic-SDK von OpenCode den Aufruf nicht korrekt verarbeiten.

APIYI (apiyi.com) unterstützt sowohl das OpenAI-kompatible Format als auch das native Anthropic-Format und kann dieses Problem vollständig lösen.

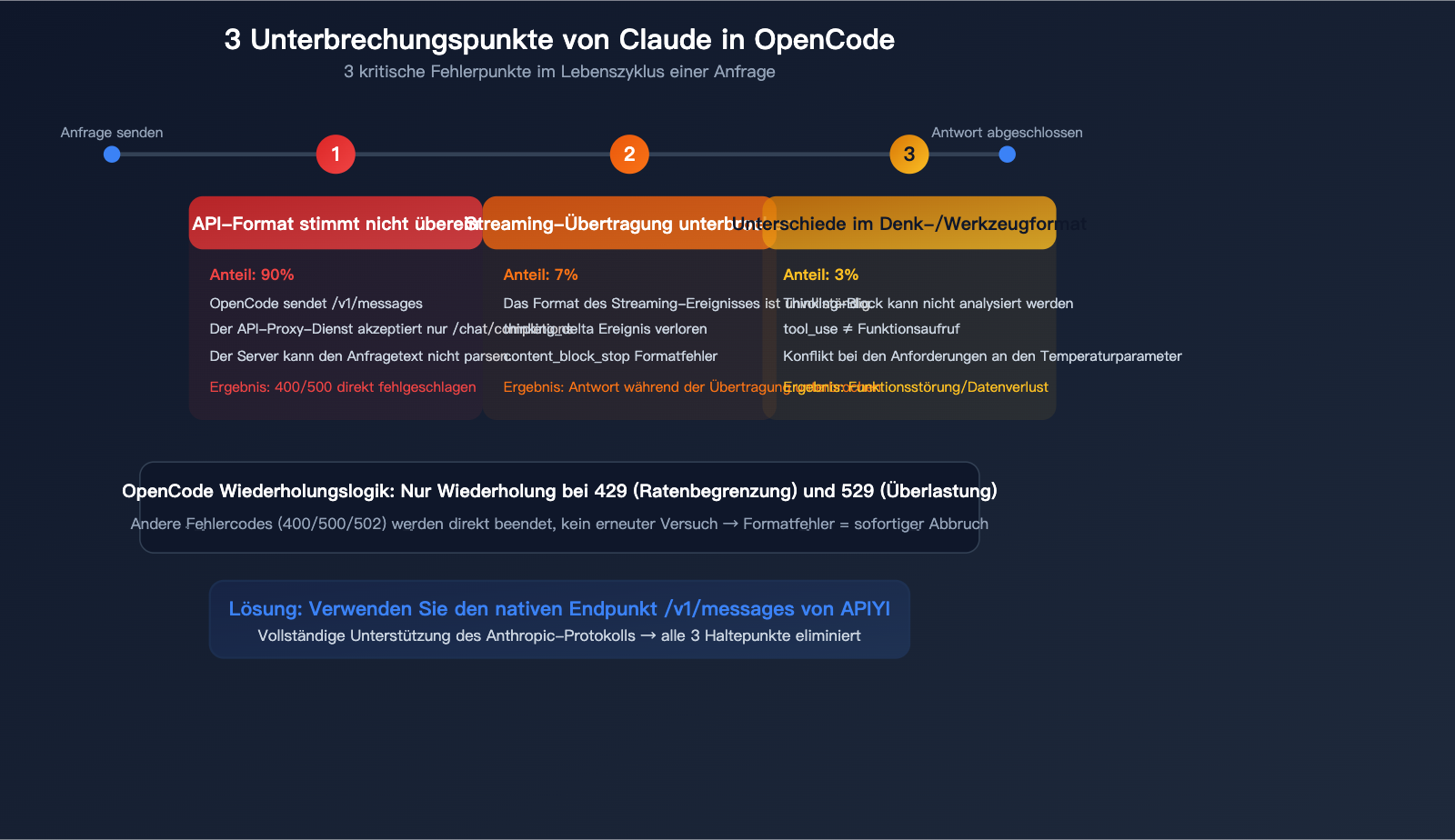

3 Grundlegende Ursachen für Verbindungsabbrüche von Claude in OpenCode

Ursache 1: Nicht übereinstimmendes API-Format (am häufigsten)

Dies ist die Ursache für 90 % der Probleme, auf die Benutzer stoßen.

Der Claude-Aufrufpfad von OpenCode:

OpenCode → Anthropic Go SDK → POST /v1/messages

↑ Verwendet natives Anthropic-Format

Schnittstellen, die von vielen API-Proxy-Diensten nur bereitgestellt werden:

API-Proxy-Dienst → Unterstützt nur POST /v1/chat/completions

↑ OpenAI-kompatibles Format

Die Anforderungsstrukturen beider Formate unterscheiden sich grundlegend:

| Vergleich | Anthropic-nativ (/v1/messages) |

OpenAI-kompatibel (/v1/chat/completions) |

|---|---|---|

| Anfrage-Endpunkt | /v1/messages |

/v1/chat/completions |

| Authentifizierungs-Header | x-api-key: sk-ant-xxx |

Authorization: Bearer sk-xxx |

| Nachrichtenformat | messages: [{role, content: [{type, text}]}] |

messages: [{role, content: "text"}] |

| System-Eingabeaufforderung | system: "..." (Top-Level-Feld) |

messages: [{role: "system", content: "..."}] |

| Tool-Aufruf | tool_use / tool_result Typ |

function_call / tool_calls Format |

| Streaming-Antwort | message_start, content_block_delta |

data: {"choices": [...]} |

| Erweitertes Denken | thinking Block nativ unterstützt |

Nicht unterstützt oder erfordert spezielle Verarbeitung |

Wenn OpenCode eine Anfrage im Anthropic-Format an einen Endpunkt sendet, der nur das OpenAI-Format unterstützt, kann der Server die Anfrage nicht parsen und gibt einen Fehler zurück oder bricht die Verbindung ab.

Ursache 2: Unterbrechung der Streaming-Übertragung

OpenCode verwendet Messages.NewStreaming() des Anthropic-SDKs für Streaming-Antworten. Die Ereignissequenz während des Streamings sieht wie folgt aus:

ContentBlockStartEvent → ContentBlockDeltaEvent (mehrfach) → ContentBlockStopEvent → MessageStopEvent

Wenn der API-Proxy-Dienst das native Anthropic-Streaming-Format nicht vollständig unterstützt (z. B. wenn keine thinking_delta-Ereignisse zurückgegeben werden oder das content_block_stop-Format inkorrekt ist), schlägt die Ereignis-Analyse von OpenCode fehl und die Verbindung wird unterbrochen.

Die Wiederholungslogik von OpenCode deckt nur HTTP 429 (Rate Limiting) und 529 (Überlastung) ab. Andere Fehlercodes führen zu einem sofortigen Abbruch ohne Wiederholungsversuch. Das bedeutet, dass 400/500-Antworten aufgrund von Formatfehlern sofort zum Scheitern führen.

Ursache 3: Formatunterschiede bei erweitertem Denken und Tool-Aufrufen

OpenCode verfügt über eine spezielle Verarbeitungslogik für das erweiterte Denken von Claude:

- Wird automatisch aktiviert, wenn die Benutzernachricht das Schlüsselwort "think" enthält.

- Nach der Aktivierung werden 80 % der

maxTokensals Budget für das Denken zugewiesen. - Die Temperatur wird erzwungen auf 1,0 gesetzt.

Wenn der API-Proxy-Dienst das native thinking-Block-Format von Anthropic nicht unterstützt, gehen die Denkprozesse verloren oder führen zu Analysefehlern. Ebenso unterscheiden sich die nativen tool_use / tool_result-Formate von Anthropic grundlegend von den function_call / tool_calls-Formaten von OpenAI.

Lösung: Verwendung der API-Schnittstelle mit nativem Anthropic-Format

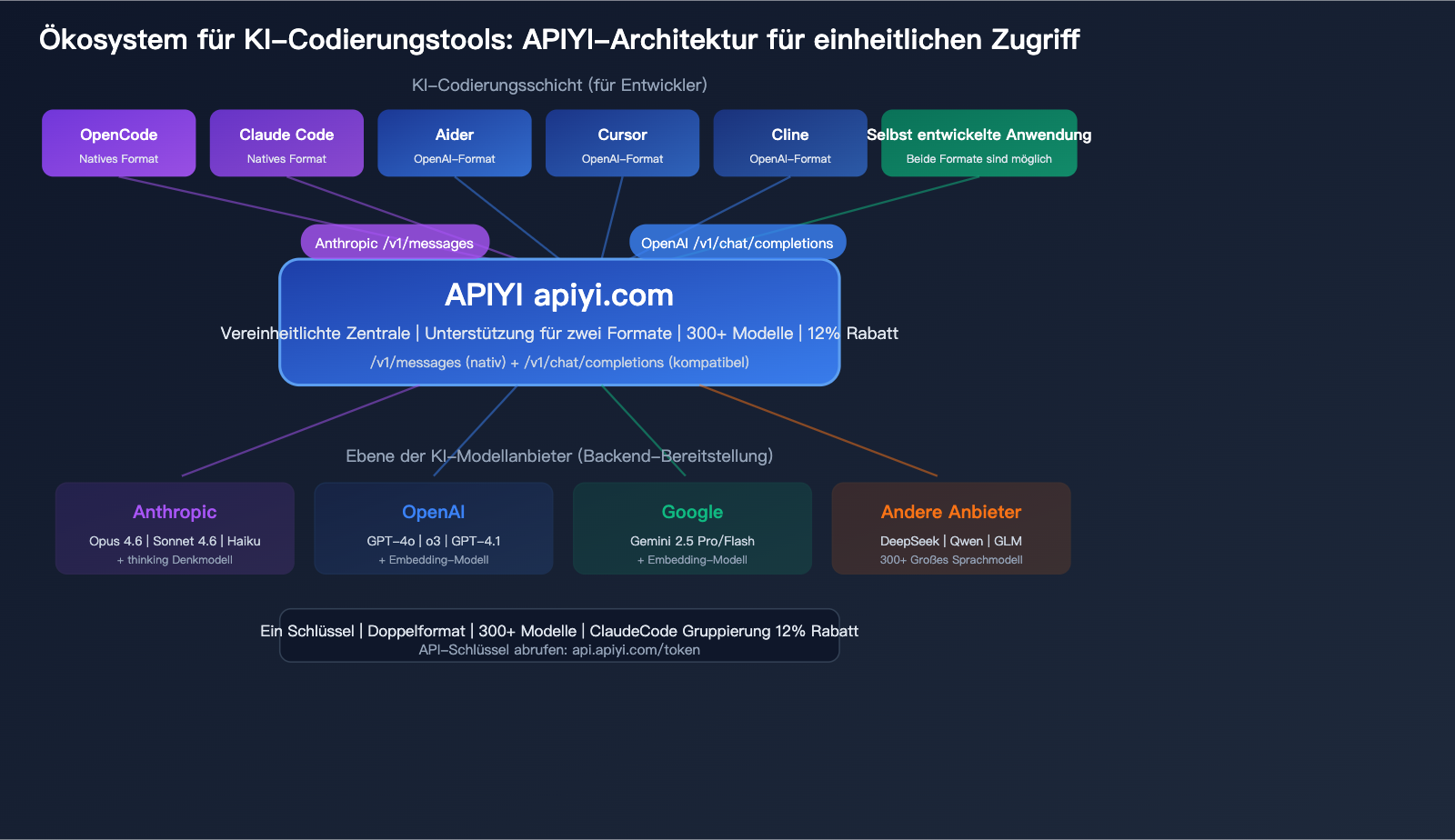

APIYI Dual-Format-Support-Architektur

APIYI (apiyi.com) unterstützt gleichzeitig zwei API-Formate, sodass Entwickler je nach Anforderung ihrer Tools wählen können:

| Format | Request-Endpunkt | Geeignete Tools | Funktionsumfang |

|---|---|---|---|

| Anthropic nativ | https://api.apiyi.com/v1/messages |

OpenCode/Crush, Claude Code | 100% vollständig |

| OpenAI-kompatibel | https://api.apiyi.com/v1/chat/completions |

Aider, Cursor, eigene Anwendungen | Grundfunktionen |

Lösung 1: Konfiguration des nativen Anthropic-Formats in OpenCode (empfohlen)

Da der Anthropic-Anbieter in OpenCode keine direkte Konfiguration der Base URL vorsieht, muss dies über Umgebungsvariablen erfolgen:

# Anthropic API-Schlüssel festlegen (APIYI-Schlüssel verwenden)

export ANTHROPIC_API_KEY="sk-deinAPIYIkey"

# Anthropic Base URL festlegen (auf die native APIYI-Schnittstelle verweisen)

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

# OpenCode starten

opencode

Alternativ in der Konfigurationsdatei .opencode.json:

{

"providers": {

"anthropic": {

"apiKey": "sk-deinAPIYIkey"

}

},

"agents": {

"coder": {

"model": "claude-sonnet-4-6",

"maxTokens": 16000

},

"task": {

"model": "claude-haiku-4-5-20251001",

"maxTokens": 8000

}

}

}

Verwendung mit Umgebungsvariablen:

# In .bashrc oder .zshrc hinzufügen

export ANTHROPIC_API_KEY="sk-deinAPIYIkey"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

Auf diese Weise ruft OpenCode über das native Anthropic-SDK https://api.apiyi.com/v1/messages auf und behält alle nativen Funktionen bei: Prompt Caching, erweitertes Denken (Thinking) und native Tool-Aufrufe.

Lösung 2: Verwendung des OpenAI-kompatiblen Formats über Local Provider (Backup)

Falls Lösung 1 nicht funktioniert, kann APIYI als Local Provider für OpenCode konfiguriert werden:

# Local-Endpunkt festlegen

export LOCAL_ENDPOINT="https://api.apiyi.com/v1"

export LOCAL_API_KEY="sk-deinAPIYIkey"

{

"providers": {

"local": {

"apiKey": "sk-deinAPIYIkey"

}

},

"agents": {

"coder": {

"model": "claude-sonnet-4-6",

"maxTokens": 16000

}

}

}

Hinweis: Diese Lösung nutzt das OpenAI-kompatible Format (/v1/chat/completions), wodurch folgende native Funktionen verloren gehen:

- Prompt Caching (Cache-Treffer)

- Natives erweitertes Denken (Thinking-Block)

- Natives Anthropic-Tool-Aufrufformat

💡 Empfehlung: Verwenden Sie bevorzugt Lösung 1 (natives Anthropic-Format), um den vollen Funktionsumfang und die beste Stabilität zu erhalten.

Wenn Sie Ihren Schlüssel im APIYI-Backend (apiyi.com) abrufen, wählen Sie die Gruppe 【ClaudeCode】, um von einem Rabatt von 88% zu profitieren.

Vollständiger Leitfaden für den Claude-Modellaufruf über APIYI

Abrufen und Konfigurieren des API-Schlüssels

| Schritt | Aktion | Hinweis |

|---|---|---|

| 1. Schlüssel abrufen | Besuchen Sie api.apiyi.com/token |

Verwaltung der Token im Backend |

| 2. Token auswählen | Standard-Token nutzen oder neu erstellen | Bei Neuerstellung Gruppe 【ClaudeCode】 für 12 % Rabatt wählen |

| 3. Base URL notieren | https://api.apiyi.com |

Einheitliche Einstiegsadresse |

Unterstützte Anfrageformate

Format 1: Anthropic natives Format (Empfohlen für OpenCode/Claude Code)

Anfrage-URL: https://api.apiyi.com/v1/messages

import anthropic

client = anthropic.Anthropic(

api_key="sk-DEIN-APIYI-SCHLUESSEL",

base_url="https://api.apiyi.com"

)

message = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=4096,

messages=[

{"role": "user", "content": "Schreibe einen Quicksort-Algorithmus in Python"}

]

)

print(message.content[0].text)

Format 2: OpenAI-kompatibles Format (Empfohlen für Aider/Cursor/eigene Anwendungen)

Anfrage-URL: https://api.apiyi.com/v1/chat/completions

import openai

client = openai.OpenAI(

api_key="sk-DEIN-APIYI-SCHLUESSEL",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[

{"role": "user", "content": "Schreibe einen Quicksort-Algorithmus in Python"}

]

)

print(response.choices[0].message.content)

Liste der unterstützten Claude-Modelle

Aktuelle Hauptmodelle (Empfohlen):

| Modell-ID | Serie | Positionierung | Anwendungsfall |

|---|---|---|---|

claude-opus-4-6 |

Opus | Stärkste Schlussfolgerung | Komplexe Architektur, Tiefenanalyse |

claude-sonnet-4-6 |

Sonnet | Ausgewogene Leistung | Tägliches Programmieren, Code-Reviews |

claude-haiku-4-5-20251001 |

Haiku | Schnelle Antwort | Einfache Aufgaben, Klassifizierung, Extraktion |

Modelle mit Schlussfolgerung (Erzwingt erweitertes Denken):

| Modell-ID | Hinweis |

|---|---|

claude-opus-4-6-thinking |

Opus + erzwungenes Denken |

claude-sonnet-4-6-thinking |

Sonnet + erzwungenes Denken |

claude-haiku-4-5-20251001-thinking |

Haiku + erzwungenes Denken |

Modelle mit Schlussfolgerung basieren auf demselben zugrunde liegenden Modell, erzwingen jedoch den "Thinking"-Modus (erweitertes Denken) für detailliertere Herleitungen, ideal für komplexe Analysen.

Code für den Aufruf mit erweitertem Denken (Anthropic natives Format)

import anthropic

client = anthropic.Anthropic(

api_key="sk-DEIN-APIYI-SCHLUESSEL",

base_url="https://api.apiyi.com"

)

# Nutzung des Thinking-Modells mit erzwungenem erweitertem Denken

message = client.messages.create(

model="claude-sonnet-4-6-thinking",

max_tokens=16000,

thinking={

"type": "enabled",

"budget_tokens": 10000 # Token-Budget für den Denkprozess

},

messages=[

{"role": "user", "content": "Analysiere die Zeitkomplexität dieses Codes und optimiere ihn"}

]

)

for block in message.content:

if block.type == "thinking":

print(f"Denkprozess:\n{block.thinking}")

elif block.type == "text":

print(f"Endgültige Antwort:\n{block.text}")

🚀 Schnellstart: Besuchen Sie APIYI unter

api.apiyi.com/token, um Ihren Schlüssel zu erhalten.

Wählen Sie die Gruppe 【ClaudeCode】 für 12 % Rabatt.

Ein Schlüssel unterstützt sowohl das native Anthropic-Format als auch das OpenAI-kompatible Format

und ist mit allen gängigen KI-Coding-Tools wie OpenCode, Claude Code, Aider und Cursor kompatibel.

Optimale Einbindung für KI-Coding-Tools

| Tool | Empfohlenes Format | Base URL | Modell-Empfehlung |

|---|---|---|---|

| OpenCode/Crush | Anthropic nativ | https://api.apiyi.com |

claude-sonnet-4-6 |

| Claude Code | Anthropic nativ | https://api.apiyi.com |

claude-sonnet-4-6 |

| Aider | OpenAI-kompatibel | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| Cursor | OpenAI-kompatibel | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| Cline (VS Code) | OpenAI-kompatibel | https://api.apiyi.com/v1 |

claude-sonnet-4-6 |

| Eigene Apps (Python) | Beide möglich | Siehe oben | Nach Bedarf |

Konfigurations-Kurzübersicht

OpenCode/Crush:

export ANTHROPIC_API_KEY="sk-DEIN-APIYI-SCHLUESSEL"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

Claude Code:

export ANTHROPIC_API_KEY="sk-DEIN-APIYI-SCHLUESSEL"

export ANTHROPIC_BASE_URL="https://api.apiyi.com"

claude

Aider:

export OPENAI_API_KEY="sk-DEIN-APIYI-SCHLUESSEL"

export OPENAI_API_BASE="https://api.apiyi.com/v1"

aider --model claude-sonnet-4-6

🎯 Zentrale Verwaltung: Verwalten Sie mit einem einzigen API-Schlüssel von APIYI (apiyi.com) alle Ihre KI-Coding-Tools.

Unterstützung für über 300 Modelle (Claude, GPT, Gemini etc.) bei einheitlicher Abrechnung und Verwaltung.

Häufig gestellte Fragen

Q1: Was tun, wenn OpenCode „agent coder not found“ meldet?

Dies ist der häufigste Fehler in OpenCode und bedeutet, dass keine gültige Konfiguration für den KI-Anbieter gefunden wurde. Überprüfen Sie folgende Punkte: 1) Ist die Umgebungsvariable ANTHROPIC_API_KEY gesetzt und gültig? 2) Ist providers.anthropic.apiKey in der Datei .opencode.json korrekt eingetragen? 3) Verfügt der Schlüssel über ein ausreichendes Guthaben? Über APIYI (apiyi.com/token) bezogene Schlüssel können direkt ohne weitere Konfiguration verwendet werden.

Q2: Warum ist das native Anthropic-Format stabiler als das OpenAI-kompatible Format?

Da OpenCode das offizielle Go SDK von Anthropic verwendet, werden Anthropic-spezifische Streaming-Ereignisse, Wiederholungslogiken und Fehlerbehandlungen direkt vom SDK verarbeitet. Bei der Verwendung des OpenAI-kompatiblen Formats ist eine Zwischenschicht zur Konvertierung erforderlich. Dabei können kritische Informationen wie thinking_delta-Ereignisse oder tool_use-Formate verloren gehen, was zu Parsing-Fehlern führt. Der /v1/messages-Endpunkt von APIYI (apiyi.com) unterstützt das native Anthropic-Protokoll vollständig, sodass keine Formatkonvertierung notwendig ist.

Q3: Was ist der Unterschied zwischen Thinking-Modellen und Standard-Modellen? Wann sollte man welches verwenden?

claude-sonnet-4-6 und claude-sonnet-4-6-thinking basieren auf demselben Modell. Die Thinking-Version erzwingt jedoch einen erweiterten Denkprozess und gibt den detaillierten logischen Ablauf aus. Die Standard-Version aktiviert dies nicht standardmäßig (in OpenCode wird es automatisch aktiviert, wenn die Nachricht das Schlüsselwort "think" enthält). Empfehlung: Nutzen Sie für die tägliche Programmierung die Standard-Version (schneller und Token-effizienter) und für komplexe Architekturdesigns oder beim Debugging die Thinking-Version.

Q4: OpenCode wurde in Crush umbenannt. Hat sich die Konfiguration geändert?

Die Kernarchitektur ist unverändert geblieben; Crush übernimmt den gesamten Code von OpenCode. Die Konfigurationsdatei kann je nach Version von .opencode.json zu .crush.json gewechselt haben, aber die Umgebungsvariablen bleiben gleich. Die Konfiguration von ANTHROPIC_API_KEY und ANTHROPIC_BASE_URL erfolgt identisch. Es wird empfohlen, die neueste Version von Crush zu verwenden, um von besserer Stabilität und neuen Funktionen zu profitieren.

Zusammenfassung: Die richtige API-Formatierung sorgt für Stabilität bei Claude in OpenCode

Der häufige Abbruch von Claude-Modellen in OpenCode/Crush hat eine klare Ursache: Nicht übereinstimmende API-Formate. OpenCode verwendet das native Anthropic-Format, während viele API-Proxy-Dienste nur das OpenAI-kompatible Format unterstützen.

Die Lösung ist eindeutig:

- Verwenden Sie einen API-Dienst, der das native Anthropic-Format unterstützt – den

/v1/messages-Endpunkt von APIYI. - Konfigurieren Sie die korrekten Umgebungsvariablen –

ANTHROPIC_BASE_URL=https://api.apiyi.com. - Wählen Sie das passende Modell –

claude-sonnet-4-6für den täglichen Gebrauch undclaude-sonnet-4-6-thinkingfür komplexe Schlussfolgerungen.

Wir empfehlen, alle API-Aufrufe für KI-Codierungstools zentral über APIYI (apiyi.com) zu verwalten. Besuchen Sie api.apiyi.com/token, um Ihren Schlüssel zu erhalten, und wählen Sie die Gruppe 【ClaudeCode】 für 12 % Rabatt. Ein einziger Schlüssel ist sowohl mit dem nativen Anthropic-Format als auch mit dem OpenAI-kompatiblen Format kompatibel und unterstützt alle gängigen KI-Codierungstools auf dem Markt.

📝 Autor: APIYI Technical Team | APIYI apiyi.com – Die einheitliche Plattform für den Zugriff auf über 300 große Sprachmodelle.

Referenzen

-

OpenCode GitHub-Repository (archiviert): Originaler Projektcode und Dokumentation

- Link:

github.com/opencode-ai/opencode - Hinweis: Wurde in Crush umbenannt.

- Link:

-

Crush GitHub-Repository: Das aktive Nachfolgeprojekt

- Link:

github.com/charmbracelet/crush - Hinweis: Die neueste, vom Charm-Team gewartete Version.

- Link:

-

Anthropic API-Dokumentation: Spezifikationen für das native Messages API-Format

- Link:

docs.anthropic.com/en/api/messages - Hinweis: Vollständiges Anforderungs- und Antwortformat für den

/v1/messages-Endpunkt.

- Link:

-

APIYI-Dokumentation: Leitfaden zur Claude API-Anbindung

- Link:

apiyi.com - Hinweis: Unterstützt sowohl das native Anthropic-Format als auch das OpenAI-kompatible Format.

- Link: